Last updated: April 17, 2026

L’intelligenza artificiale sta trasformando tutto: il business, la creatività e la vita di tutti i giorni. Ma con grande potere arriva una grande responsabilità etica. Quando le aziende tagliano gli angoli su privacy, trasparenza o equità, intervengono i regolatori. Diamo un’occhiata a cosa sta succedendo, chi è stato beccato e come costruire un’IA che guadagni fiducia invece di multe.

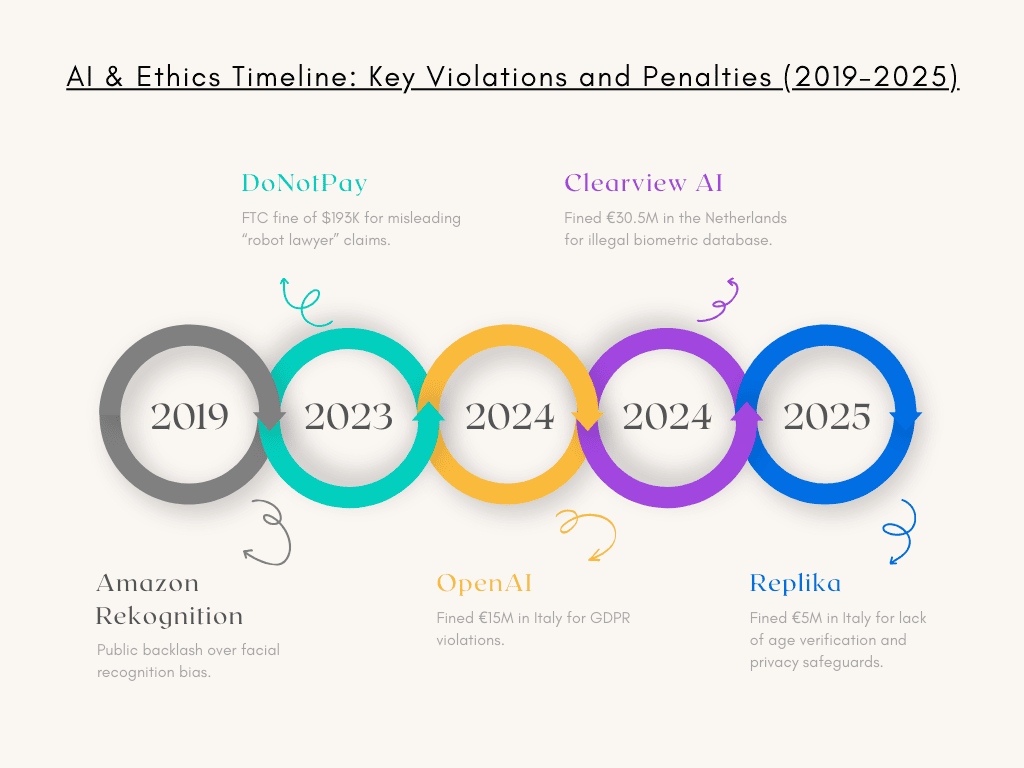

Violazioni Reali: Cosa è Successo e le Sanzioni

- OpenAI (2024) – multata di 15 milioni di euro in Italia per aver raccolto dati personali senza una base giuridica adeguata e per mancanza di trasparenza.

- Clearview AI (2024) – multata di 30,5 milioni di euro nei Paesi Bassi per aver costruito un database illegale di riconoscimento facciale biometrico estrapolato dal web.

- Replika (2025) – multata di 5 milioni di euro in Italia per insufficiente verifica dell’età e salvaguardie sulla privacy.

- DoNotPay (2023–24) – multata di 193.000 dollari negli Stati Uniti per affermazioni ingannevoli sull’essere un “robot avvocato”.

- Amazon Rekognition (2019) – ha affrontato una forte reazione pubblica per gravi pregiudizi nel riconoscimento facciale, in particolare nell’identificare erroneamente donne e persone con la pelle più scura, portando alcuni dipartimenti di polizia statunitensi a smettere di usare lo strumento.

Questi casi sono più che punizioni, sono avvertimenti. Gli errori etici costano denaro, reputazione e fiducia pubblica.

Regolamentazione: Dove Siamo e Cosa Arriverà

- L’EU Artificial Intelligence Act, entrato in vigore nell’agosto 2024, stabilisce regole severe per i sistemi di IA ad alto rischio. Richiede trasparenza, supervisione umana e valutazioni del rischio, con multe fino a 35 milioni di euro o il 7% del fatturato globale per violazioni gravi.

- Il GDPR rimane la base per la privacy nell’UE, richiedendo una base giuridica per l’uso dei dati, chiara trasparenza e protezione dei dati sensibili come i dati biometrici e la geolocalizzazione.

- Negli Stati Uniti, non esiste una legge federale unica come il GDPR, ma l’applicazione sta aumentando attraverso agenzie come la FTC, che si occupa di affermazioni ingannevoli, pratiche ingannevoli e violazioni della privacy (FTC).

Sfide Etiche: Bias, Equità e Fiducia

Oltre alle multe e alla regolamentazione, le questioni etiche sono al centro del dibattito sull’IA. Il caso di Amazon Rekognition (2019) ha rivelato quanto possa essere dannoso il bias algoritmico. Il sistema ha mostrato tassi di errore significativamente più elevati nell’identificare donne e persone con la pelle più scura, scatenando un ampio dibattito pubblico sull’equità nelle tecnologie biometriche e portando diversi dipartimenti di polizia statunitensi a sospenderne l’uso. Tali esempi illustrano come il bias nei dati di addestramento possa portare a risultati ingiusti nelle assunzioni, nei prestiti o nell’applicazione della legge. Allo stesso tempo, la mancanza di trasparenza spesso trasforma l’IA in una “scatola nera”, rendendo difficile spiegare o verificare le decisioni. E quando manca la supervisione umana, errori o abusi possono diffondersi rapidamente, causando danni diffusi prima che qualcuno abbia la possibilità di intervenire.

Costruire un Futuro Etico per l’IA

Per garantire che l’IA si sviluppi in modi che servano l’umanità, le aziende devono fondare i propri sistemi su solide basi etiche. Ciò inizia con una chiara base giuridica per l’uso dei dati, accompagnata da piena trasparenza in modo che gli utenti comprendano cosa viene raccolto e perché. Proteggere gli utenti più giovani attraverso una rigorosa verifica dell’età e salvaguardie, e mantenere un monitoraggio continuo con strumenti AI-DR (AI Detection & Response), garantisce che i rischi vengano individuati precocemente. Allo stesso tempo, l’equità richiede dati di addestramento diversificati che minimizzino il bias, mentre l’allineamento con le normative globali aiuta a mantenere i sistemi responsabili. Ma l’etica non riguarda solo l’evitare le multe, si tratta di garantire che l’IA diventi una forza per il bene. Se progettata in modo responsabile, l’IA può potenziare la creatività, migliorare la sanità, l’istruzione e rendere la vita quotidiana più fluida, il tutto senza minare la fiducia o la dignità umana. La vera sfida, e opportunità, è costruire un’IA che non funzioni solo per il business, ma che funzioni per le persone e per il mondo in cui vivono. Questo quadro più ampio si collega anche alla politica statunitense, in particolare al supporto presidenziale per l’IA, che sta plasmando gli investimenti e le opportunità future.

Domande Frequenti (FAQ) su IA ed Etica

1. Perché l’etica dell’IA è così importante oggi?

Perché i sistemi di IA influenzano decisioni critiche in sanità, assunzioni, applicazione della legge e vita quotidiana.

2. Qual è il rischio maggiore di un’IA non etica?

La combinazione di bias e mancanza di trasparenza: errori su larga scala possono causare enormi danni sociali.

3. Quali sono alcuni esempi reali di aziende IA che hanno subito sanzioni?

OpenAI (15 milioni di euro, 2024) – per aver raccolto dati senza base giuridica.

Clearview AI (30,5 milioni di euro, 2024) – per aver creato un database biometrico facciale illegale.

Replika (5 milioni di euro, 2025) – per non aver implementato una corretta verifica dell’età e privacy.

DoNotPay (193.000 dollari, 2023–24) – per affermazioni ingannevoli sull’essere un “robot avvocato”.

Amazon Rekognition (2019) – ha affrontato una forte reazione pubblica per gravi pregiudizi nel riconoscimento facciale.

4. Esiste una regolamentazione globale per l’IA?

Non ancora. L’EU AI Act è il quadro più completo finora.

5. Cos’è l’EU AI Act?

Un quadro normativo che richiede trasparenza, supervisione umana e vieta pratiche pericolose, con multe fino a 35 milioni di euro o il 7% del fatturato.

6. Come possono le aziende ridurre il bias nell’IA?

Utilizzando dataset diversificati, eseguendo audit regolari sul bias e coinvolgendo la supervisione umana.

7. I bambini possono usare in sicurezza gli strumenti di IA?

Sì, ma solo se ci sono salvaguardie rigorose, controlli parentali e minimizzazione dei dati.

8. Che ruolo gioca la FTC nell’etica dell’IA?

Applica le regole negli Stati Uniti contro affermazioni ingannevoli sull’IA e violazioni della privacy.

9. Perché Amazon Rekognition è stato controverso?

Perché nel 2019 ha identificato erroneamente donne e persone con la pelle più scura con tassi elevati, sollevando preoccupazioni sulla discriminazione.

10. Qual è il futuro dell’etica dell’IA?

Più regolamentazioni globali, maggiore responsabilità aziendale e crescente domanda da parte degli utenti di fiducia e trasparenza.

Da Leggere

Supporto Presidenziale USA per l’IA nel 2025

Agenti IA Autonomi: L’Alba dell’Intelligenza Auto-Eseguibile