Last updated: April 17, 2026

Pourquoi la Maison Blanche soutient l’IA

L’administration actuelle des États-Unis considère l’intelligence artificielle comme un levier stratégique pour la croissance économique, la sécurité nationale et la compétitivité mondiale. Le plan d’action national America’s AI Action Plan de la Maison Blanche présente une feuille de route nationale pour l’innovation, les compétences et les infrastructures, positionnant explicitement l’IA comme un domaine où les États-Unis doivent être leaders.

Comment le Président soutient l’IA

1) Actions exécutives et stratégie nationale

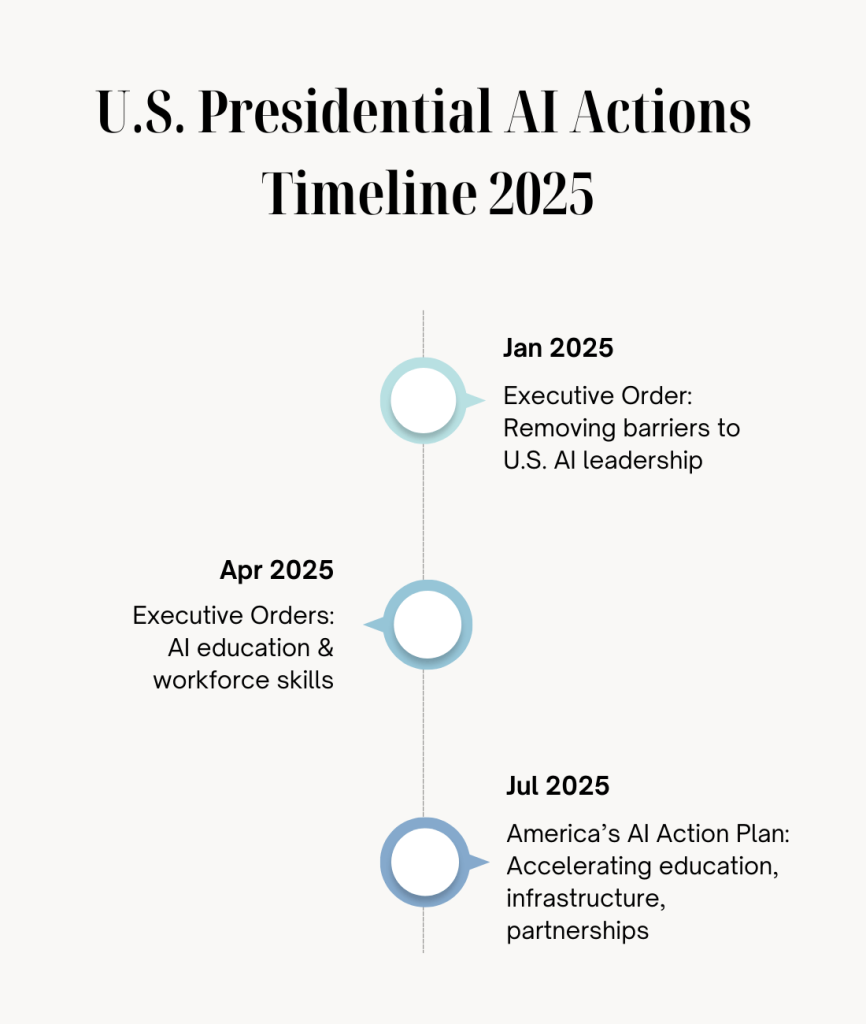

- America’s AI Action Plan (Juillet 2025) : Charge les agences fédérales d’accélérer l’éducation à l’IA, de renforcer les infrastructures nationales et d’élargir les partenariats public-privé, tout en se prémunissant contre les usages “orwelliens” de l’IA.

- Ordre exécutif pour “supprimer les obstacles” au leadership américain en IA (Janvier 2025) : Signale une posture dérégulatrice et pro-innovation dans toutes les agences fédérales.

- EOs Éducation & Emploi (Avril 2025) : Le plan d’action fait référence à de nouveaux décrets axés sur l’éducation à l’IA pour les jeunes et les compétences pour les futurs emplois.

2) Réunion avec l’industrie technologique

Le Président et le personnel de haut rang s’engagent activement avec les grands leaders de la tech (Apple, Meta, Microsoft, Google, OpenAI et d’autres) à la Maison Blanche pour s’aligner sur les priorités en matière d’éducation à l’IA, d’innovation et de politique, des réunions très médiatisées qui transmettent également une confiance du marché.

3) Infrastructure de normes, de risques et de sécurité

Plutôt que de freiner l’innovation, les organismes fédéraux s’appuient sur le Cadre de gestion des risques de l’IA (AI RMF) du NIST et ses nouveaux profils pour guider le déploiement sécurisé dans le gouvernement et l’industrie, une approche qui privilégie les contrôles de risques pratiques plutôt que les interdictions prescriptives.

La Maison Blanche a souligné l’importance de développer des normes claires et un cadre de gestion des risques robuste pour guider le déploiement sécurisé de l’intelligence artificielle. Cette approche privilégie les contrôles de risques pratiques plutôt que les interdictions prescriptives, s’alignant sur les discussions mondiales plus larges concernant l’IA responsable et garantissant que l’innovation se poursuit tout en maintenant la confiance du public.

4) Achats et projets pilotes fédéraux

Les agences sont encouragées à adopter des IA commerciales éprouvées. Des partenariats comme Palantir + Accenture Federal Services visent à intégrer l’aide à la décision basée sur l’IA “dans le tissu des agences gouvernementales”, accélérant les cas d’usage réels.

5) Engagement législatif

Au Capitole, des mesures comme le CREATE AI Act de 2025 (pour élargir les ressources nationales de recherche en IA) indiquent une dynamique bipartite pour financer l’accès au calcul, aux données et à la recherche, complétant les actions exécutives. Les États bougent aussi rapidement, avec des dizaines de nouvelles mesures sur l’IA en 2025.

Comment l’administration soutient l’IA en pratique

- Financement et incitations : Prioriser les infrastructures pertinentes pour l’IA dans les budgets fédéraux et encourager les dépenses d’investissement privées par des engagements d’achat.

- Normes & directives : Déployer l’adoption de l’AI RMF dans les agences ; publier des profils spécifiques au domaine (par exemple, pour l’IA générative et les déploiements respectueux des droits de l’homme).

- Talents & compétences : Développer des programmes d’éducation et de formation à l’IA (jeunes, métiers, perfectionnement) via des directives exécutives et une coordination inter-agences.

- Projets pilotes public-privé : Utiliser les OTA, les flexibilités du FAR et les programmes de défis pour tester les systèmes d’IA dans la défense, la santé, la logistique et les services aux citoyens (par exemple, le partenariat fédéral Palantir-AFS).

Réunions industrielles : Maintenir un dialogue structuré avec les PDG et les chercheurs pour s’aligner sur les obstacles liés au calcul, à la sécurité et au déploiement.

Pourquoi ce soutien est important

- Compétitivité mondiale : La stratégie nationale et l’alignement des agences réduisent les frictions politiques, accélérant la mise sur le marché des avancées et des infrastructures de l’IA.

- Sécurité pragmatique : L’utilisation de l’AI RMF crée un langage commun pour les risques sans étouffer l’innovation, offrant aux entreprises des garde-fous plus clairs.

- Le gouvernement comme client principal : Les achats fédéraux valident les produits d’IA et catalysent une adoption plus large dans l’économie.

Effets d’entraînement internationaux

Le positionnement des États-Unis façonne souvent les normes mondiales. L’accent mis par la Maison Blanche sur une approche pro-innovation avec gestion des risques, ancrée dans les directives du NIST, pousse les alliés et partenaires vers des normes compatibles et des régimes d’assurance interopérables. Les pays qui suivent la politique américaine (et les fournisseurs basés aux États-Unis) sont susceptibles de refléter des éléments de gestion des risques de type RMF, d’augmenter leur propre financement de l’IA et de courtiser les entreprises américaines pour des projets conjoints et la construction de centres de données.

Les politiques de l’administration ont déjà des répercussions mondiales, les pays suivant les initiatives américaines et augmentant leurs investissements en IA. Cela montre comment le leadership américain peut façonner les normes et accélérer l’adoption, propulsant l’impact généralisé de l’IA dans tous les secteurs, de la santé à la fabrication.

Conclusion : Que faut-il attendre ensuite

L’approche de l’administration, combinant signaux dérégulateurs et direction exécutive avec des pratiques de sécurité ancrées dans le NIST et un engagement agressif auprès de l’industrie, suggère que les États-Unis vont déployer l’IA à grande échelle dans les agences tout en courtisant les investissements privés dans le calcul, les centres de données et les modèles. Attendez-vous à des projets pilotes fédéraux élargis, à des initiatives supplémentaires en matière d’éducation à l’IA et à un alignement plus étroit avec les alliés sur les normes. D’autres gouvernements sont susceptibles de répondre avec leurs propres plans d’investissement et cadres de risque, créant une compétition de stratégies de facto, mais avec une interopérabilité croissante partout où l’AI RMF américain devient la colonne vertébrale commune.

IA et la Maison Blanche : Questions clés répondues

Qu’est-ce que l’America’s AI Action Plan ?

L’America’s AI Action Plan est une feuille de route nationale lancée par la Maison Blanche en 2025 pour développer l’éducation à l’IA, renforcer les infrastructures et stimuler l’innovation tout en gérant les risques.

Pourquoi le Président américain soutient-il l’IA ?

L’administration considère l’IA comme essentielle à la croissance économique, à la sécurité nationale et à la compétitivité mondiale, rendant le soutien fédéral indispensable pour le leadership.

Comment la Maison Blanche travaille-t-elle avec les grandes entreprises technologiques sur l’IA ?

Le Président rencontre régulièrement les dirigeants d’Apple, Meta, Microsoft, Google et OpenAI pour s’aligner sur les priorités en matière d’innovation, de politique et d’éducation de l’IA.

Quel rôle le NIST joue-t-il dans la réglementation de l’IA ?

Le Cadre de gestion des risques de l’IA (AI RMF) du NIST fournit des normes pour le déploiement sécurisé de l’IA, équilibrant l’innovation avec des contrôles de risques pratiques.

Quelles agences fédérales adoptent l’IA en 2025 ?

Les agences dans les domaines de la défense, de la santé, de la logistique et des services aux citoyens expérimentent des solutions d’IA grâce à des partenariats avec des entreprises comme Palantir et Accenture Federal Services.

Pourquoi la politique américaine sur l’IA est-elle importante au niveau mondial ?

Parce que les normes et politiques américaines définissent souvent les références mondiales, façonnant la manière dont les alliés et partenaires adoptent les cadres de l’IA et les pratiques de gestion des risques.

Lecture connexe

IA & Éthique : Règles, violations et à quoi ressemble une IA responsable

Vague d’investissements en IA par les géants de la tech en 2025