A inteligência artificial está transformando tudo – negócios, criatividade e o dia a dia. Mas com grande poder vem grande responsabilidade ética. Quando empresas cortam caminho na privacidade, transparência ou justiça, os reguladores entram em ação. Vamos dar uma olhada no que está acontecendo, quem foi pego e como construir uma IA que ganhe confiança em vez de multas.

Violações Reais: O Que Aconteceu e as Penalidades

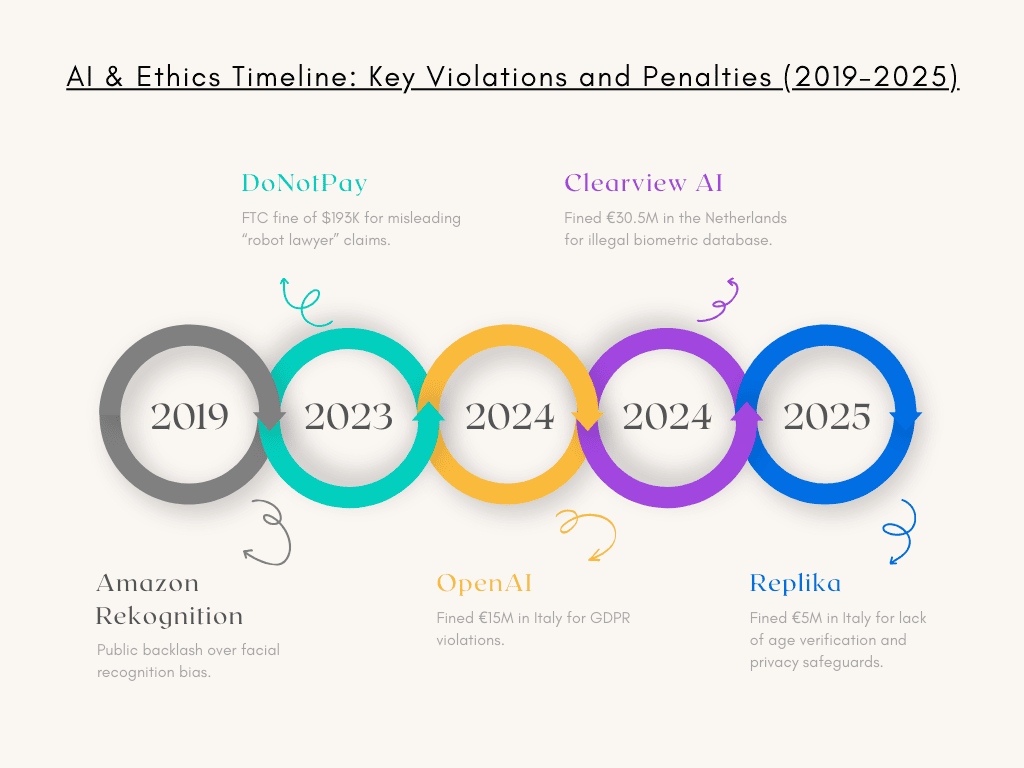

- OpenAI (2024) – multada em €15 milhões na Itália por coletar dados pessoais sem uma base legal adequada e falta de transparência.

- Clearview AI (2024) – multada em €30,5 milhões na Holanda por construir um banco de dados ilegal de reconhecimento facial biométrico coletado da web.

- Replika (2025) – multada em €5 milhões na Itália por verificação de idade e salvaguardas de privacidade insuficientes.

- DoNotPay (2023–24) – multada em US$ 193 mil nos EUA por alegações enganosas de ser um “advogado robô”.

- Amazon Rekognition (2019) – enfrentou forte reação pública por viés severo no reconhecimento facial, especialmente identificando incorretamente mulheres e pessoas de pele mais escura, levando alguns departamentos de polícia dos EUA a pararem de usar a tool.

Esses casos são mais do que punições – são avisos. Erros éticos custam dinheiro, reputação e a confiança do público.

Regulamentação: Onde Estamos e o Que Está Por Vir

- O EU Artificial Intelligence Act, que entrou em vigor em agosto de 2024, estabelece regras rigorosas para sistemas de IA de alto risco. Ele exige transparência, supervisão humana e avaliações de risco, com multas de até €35 milhões ou 7% da receita global por violações graves.

- O GDPR continua sendo a base para a privacidade na UE, exigindo uma base legal para o uso de dados, transparência clara e proteção de dados sensíveis como biometria e geolocalização.

- Nos EUA, não há uma lei federal única como o GDPR, mas a fiscalização está aumentando através de agências como a FTC, que mira alegações enganosas, práticas enganosas e violações de privacidade (FTC).

Desafios Éticos: Viés, Justiça e Confiança

Além de multas e regulamentação, questões éticas estão no centro do debate da IA. O caso do Amazon Rekognition (2019) revelou o quão prejudicial o viés algorítmico pode ser. O sistema mostrou taxas de erro significativamente mais altas na identificação de mulheres e pessoas de pele mais escura, gerando um amplo debate público sobre justiça em tecnologias biométricas e levando vários departamentos de polícia dos EUA a suspenderem seu uso. Esses exemplos ilustram como o viés nos dados de treinamento pode resultar em resultados injustos em contratações, empréstimos ou aplicação da lei. Ao mesmo tempo, a falta de transparência muitas vezes transforma a IA em uma “caixa preta”, dificultando a explicação ou auditoria de decisões. E quando a supervisão humana está ausente, erros ou uso indevido podem escalar rapidamente, causando danos generalizados antes que alguém tenha a chance de intervir.

Construindo um Futuro Ético para a IA

Para garantir que a IA se desenvolva de maneiras que sirvam à humanidade, as empresas devem basear seus sistemas em fortes fundamentos éticos. Isso começa com uma base legal clara para o uso de dados, juntamente com total transparência para que os usuários entendam o que é coletado e por quê. Proteger usuários mais jovens através de verificação de idade e salvaguardas rigorosas, e manter monitoramento contínuo com ferramentas de IA-DR (Detecção e Resposta de IA), garante que os riscos sejam detectados cedo. Ao mesmo tempo, a justiça exige dados de treinamento diversos que minimizem o viés, enquanto a conformidade com regulamentações globais ajuda a manter os sistemas responsáveis. Mas a ética não se trata apenas de evitar multas – trata-se de garantir que a IA se torne uma força para o bem. Quando projetada de forma responsável, a IA pode impulsionar a criatividade, melhorar a saúde, aprimorar a educação e tornar o dia a dia mais fluido, tudo isso sem minar a confiança ou a dignidade humana. O verdadeiro desafio – e oportunidade – é construir uma IA que não apenas funcione para os negócios, mas que funcione para as pessoas e para o mundo em que vivem. Esse quadro mais amplo também se conecta à política dos EUA – especialmente o apoio presidencial à IA, que está moldando investimentos e oportunidades futuras.

Perguntas Frequentes (FAQ) Sobre IA e Ética

1. Por que a ética da IA é tão importante hoje?

Porque os sistemas de IA influenciam decisões críticas em saúde, contratações, aplicação da lei e na vida cotidiana.

2. Qual é o maior risco de uma IA antiética?

A combinação de viés e falta de transparência – erros escalados podem causar enormes danos sociais.

3. Quais são alguns exemplos reais de empresas de IA que enfrentaram penalidades?

OpenAI (€15 milhões, 2024) – por coletar dados sem base legal.

Clearview AI (€30,5 milhões, 2024) – por criar um banco de dados biométrico facial ilegal.

Replika (€5 milhões, 2025) – por falhar em implementar verificação de idade e privacidade adequadas.

DoNotPay (US$ 193 mil, 2023–24) – por alegações enganosas de ser um “advogado robô”.

Amazon Rekognition (2019) – enfrentou reação pública por viés severo no reconhecimento facial.

4. Existe uma regulamentação global para IA?

Ainda não. O EU AI Act é o framework mais abrangente até agora.

5. O que é o EU AI Act?

Um framework regulatório que exige transparência, supervisão humana e proíbe práticas perigosas, com multas de até €35 milhões ou 7% da receita.

6. Como as empresas podem reduzir o viés da IA?

Usando datasets diversos, realizando auditorias de viés regulares e envolvendo supervisão humana.

7. Crianças podem usar ferramentas de IA com segurança?

Sim – mas apenas se houver salvaguardas rigorosas, controles parentais e minimização de dados.

8. Qual o papel da FTC na ética da IA?

Ela fiscaliza as regras nos EUA contra alegações enganosas de IA e violações de privacidade.

9. Por que o Amazon Rekognition foi controverso?

Porque em 2019 ele identificou incorretamente mulheres e pessoas de pele mais escura em altas taxas, levantando preocupações de discriminação.

10. Qual o futuro da ética da IA?

Mais regulamentações globais, maior responsabilidade corporativa e crescente demanda dos usuários por confiança e transparência.

Leitura Relacionada

Apoio Presidencial dos EUA à IA em 2025

Agentes de IA Autônomos: O Amanhecer da Inteligência Autônoma