Künstliche Intelligenz verändert gerade alles: Business, Kreativität und unser tägliches Leben. Aber mit großer Macht kommt auch große ethische Verantwortung. Wenn Unternehmen bei Datenschutz, Transparenz oder Fairness Abstriche machen, schalten sich die Regulierungsbehörden ein. Schauen wir uns mal an, was gerade passiert, wer erwischt wurde und wie wir KI bauen, die Vertrauen statt Bußgelder verdient.

Reale Verstöße: Was ist passiert und welche Strafen gab es

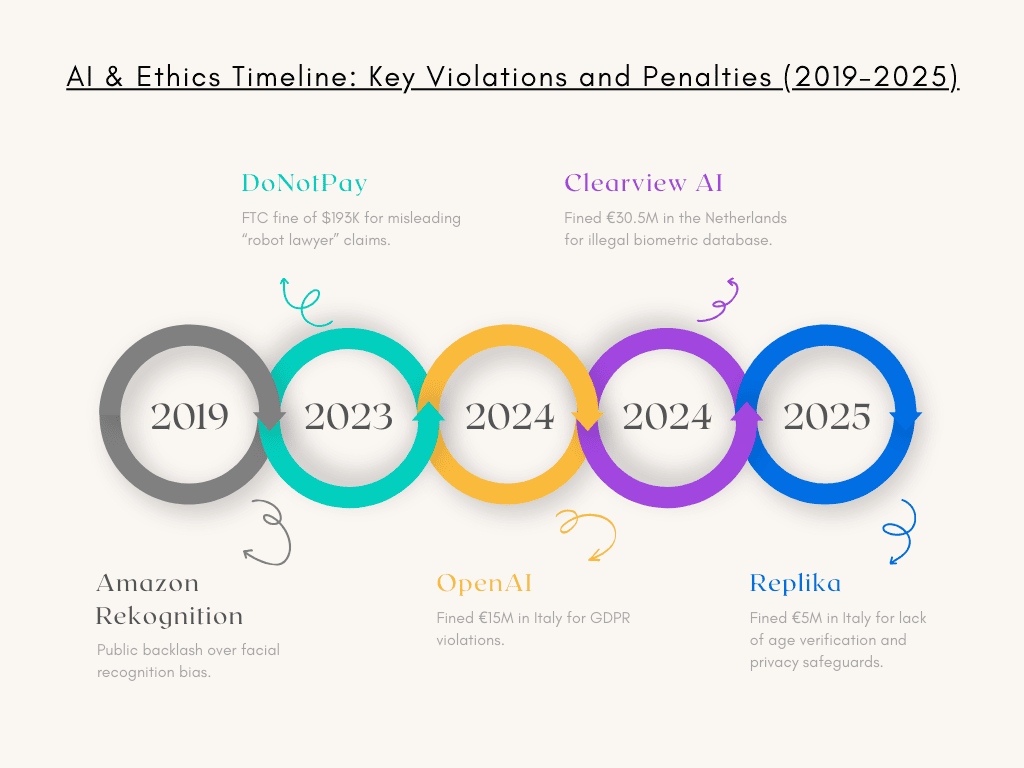

- OpenAI (2024) – in Italien mit 15 Mio. € bestraft, weil persönliche Daten ohne Rechtsgrundlage und Transparenz gesammelt wurden.

- Clearview AI (2024) – in den Niederlanden mit 30,5 Mio. € bestraft für den Aufbau einer illegalen biometrischen Gesichtserkennungsdatenbank, die aus dem Netz gesammelt wurde.

- Replika (2025) – in Italien mit 5 Mio. € bestraft wegen mangelnder Altersverifikation und Datenschutz.

- DoNotPay (2023–24) – in den USA mit 193.000 $ bestraft für irreführende Behauptungen, ein „Roboter-Anwalt“ zu sein.

- Amazon Rekognition (2019) – musste heftigen öffentlichen Gegenwind hinnehmen, weil die Gesichtserkennung stark voreingenommen war, besonders bei Frauen und Menschen mit dunklerer Haut. Das führte dazu, dass einige US-Polizeibehörden das Tool nicht mehr nutzten.

Diese Fälle sind mehr als nur Strafen – sie sind Warnungen. Ethische Fehler kosten Geld, Ansehen und das Vertrauen der Öffentlichkeit.

Regulierung: Wo wir stehen und was kommt

- Der EU AI Act, der im August 2024 in Kraft trat, legt strenge Regeln für Hochrisiko-KI-Systeme fest. Er verlangt Transparenz, menschliche Aufsicht und Risikobewertungen, mit Bußgeldern von bis zu 35 Mio. € oder 7 % des weltweiten Umsatzes bei schweren Verstößen.

- Die DSGVO bleibt die Grundlage für Datenschutz in der EU und verlangt eine Rechtsgrundlage für die Datennutzung, klare Transparenz und den Schutz sensibler Daten wie Biometrie und Geodaten.

- In den USA gibt es kein einheitliches Bundesgesetz wie die DSGVO, aber die Durchsetzung durch Behörden wie die FTC nimmt zu. Diese zielt auf irreführende Behauptungen, Täuschung und Datenschutzverletzungen ab.

Ethische Herausforderungen: Bias, Fairness & Vertrauen

Über Bußgelder und Regulierung hinaus sind ethische Fragen das Kernstück der KI-Debatte. Der Fall Amazon Rekognition (2019) hat gezeigt, wie schädlich algorithmischer Bias sein kann. Das System hatte deutlich höhere Fehlerraten bei der Identifizierung von Frauen und Menschen mit dunklerer Haut, was eine breite öffentliche Debatte über Fairness bei biometrischen Technologien auslöste und dazu führte, dass mehrere US-Polizeibehörden die Nutzung einstellten. Solche Beispiele zeigen, wie Bias in Trainingsdaten zu unfairen Ergebnissen bei Einstellungen, Kreditvergaben oder der Strafverfolgung führen kann. Gleichzeitig macht mangelnde Transparenz KI oft zu einer „Black Box“, bei der Entscheidungen schwer zu erklären oder zu überprüfen sind. Und wenn die menschliche Aufsicht fehlt, können Fehler oder Missbrauch schnell eskalieren und weitreichenden Schaden anrichten, bevor jemand eingreifen kann.

Eine ethische Zukunft für KI gestalten

Um sicherzustellen, dass KI sich so entwickelt, dass sie der Menschheit dient, müssen Unternehmen ihre Systeme auf starke ethische Grundlagen stellen. Das beginnt mit einer klaren Rechtsgrundlage für die Datennutzung, zusammen mit voller Transparenz, damit Nutzer verstehen, was gesammelt wird und warum. Der Schutz jüngerer Nutzer durch strenge Altersverifikation und Schutzmaßnahmen sowie die kontinuierliche Überwachung mit KI-DR (KI-Erkennung & Reaktion) Tools stellt sicher, dass Risiken frühzeitig erkannt werden. Gleichzeitig erfordert Fairness diverse Trainingsdaten, die Bias minimieren, während die Ausrichtung an globalen Vorschriften hilft, Systeme zur Rechenschaft zu ziehen. Aber Ethik bedeutet nicht nur, Bußgelder zu vermeiden – es geht darum, sicherzustellen, dass KI eine positive Kraft wird. Wenn KI verantwortungsvoll entwickelt wird, kann sie Kreativität fördern, die Gesundheitsversorgung verbessern, Bildung bereichern und das tägliche Leben reibungsloser gestalten, ohne dabei Vertrauen oder menschliche Würde zu untergraben. Die eigentliche Herausforderung – und Chance – ist es, KI zu bauen, die nicht nur für Unternehmen funktioniert, sondern für Menschen und die Welt, in der sie leben. Dieses größere Bild verbindet sich auch mit der US-Politik – insbesondere mit der Unterstützung von KI durch den Präsidenten, die zukünftige Investitionen und Chancen prägt.

Häufig gestellte Fragen (FAQ) zu KI & Ethik

1. Warum ist KI-Ethik heute so wichtig?

Weil KI-Systeme wichtige Entscheidungen in Bereichen wie Gesundheitswesen, Einstellung, Strafverfolgung und im täglichen Leben beeinflussen.

2. Was ist das größte Risiko unethischer KI?

Die Kombination aus Bias und mangelnder Transparenz – skalierte Fehler können enormen gesellschaftlichen Schaden anrichten.

3. Gibt es reale Beispiele von KI-Unternehmen, die Strafen erhalten haben?

OpenAI (15 Mio. €, 2024) – für das Sammeln von Daten ohne Rechtsgrundlage.

Clearview AI (30,5 Mio. €, 2024) – für die Erstellung einer illegalen biometrischen Gesichtserkennungsdatenbank.

Replika (5 Mio. €, 2025) – für mangelnde Altersverifikation und Datenschutz.

DoNotPay (193.000 $, 2023–24) – für irreführende Behauptungen, ein „Roboter-Anwalt“ zu sein.

Amazon Rekognition (2019) – musste öffentlichen Gegenwind wegen starkem Bias bei der Gesichtserkennung hinnehmen.

4. Gibt es eine globale Regulierung für KI?

Noch nicht. Der EU AI Act ist der bisher umfassendste Rahmen.

5. Was ist der EU AI Act?

Ein regulatorischer Rahmen, der Transparenz und menschliche Aufsicht vorschreibt und gefährliche Praktiken verbietet, mit Bußgeldern von bis zu 35 Mio. € oder 7 % des Umsatzes.

6. Wie können Unternehmen KI-Bias reduzieren?

Durch die Verwendung diverser Datensätze, regelmäßige Bias-Audits und die Einbeziehung menschlicher Aufsicht.

7. Können Kinder KI-Tools sicher nutzen?

Ja – aber nur, wenn es strenge Schutzmaßnahmen, elterliche Kontrolle und Datenminimierung gibt.

8. Welche Rolle spielt die FTC bei der KI-Ethik?

Sie setzt in den USA Regeln gegen irreführende KI-Behauptungen und Datenschutzverletzungen durch.

9. Warum war Amazon Rekognition umstritten?

Weil es 2019 Frauen und Menschen mit dunklerer Haut mit hoher Rate falsch identifizierte, was Diskriminierungsbedenken aufwarf.

10. Was bringt die Zukunft der KI-Ethik?

Mehr globale Regulierungen, stärkere unternehmerische Verantwortung und eine wachsende Nachfrage der Nutzer nach Vertrauen und Transparenz.

Das könnte dich auch interessieren

US-Präsidentielle Unterstützung für KI in 2025

Autonome KI-Agenten: Die Ära der selbstlaufenden Intelligenz