Искусственный интеллект меняет всё – бизнес, творчество и повседневную жизнь. Но с большой силой приходит и большая этическая ответственность. Когда компании идут на компромиссы в вопросах конфиденциальности, прозрачности или справедливости, вмешиваются регуляторы. Давайте посмотрим, что происходит, кто попался, и как создавать ИИ, который вызывает доверие, а не штрафы.

Реальные нарушения: что случилось и какие были наказания

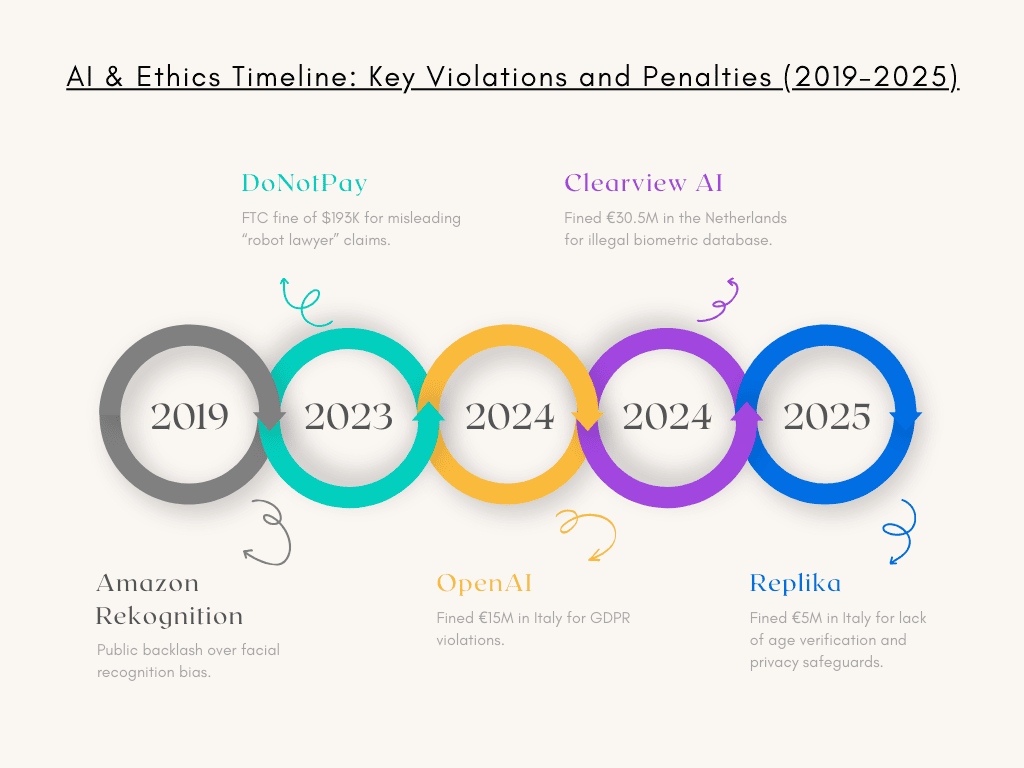

- OpenAI (2024) – оштрафована на 15 млн евро в Италии за сбор персональных данных без законных оснований и недостаточную прозрачность.

- Clearview AI (2024) – оштрафована на 30.5 млн евро в Нидерландах за создание незаконной базы данных биометрических лиц, собранной из интернета.

- Replika (2025) – оштрафована на 5 млн евро в Италии за недостаточную проверку возраста и меры по защите конфиденциальности.

- DoNotPay (2023–24) – оштрафована на 193 тыс. долларов в США за ложные заявления о том, что является «роботом-юристом».

- Amazon Rekognition (2019) – столкнулась с серьёзной критикой общественности из-за сильной предвзятости в распознавании лиц, особенно в идентификации женщин и людей с тёмной кожей, что привело к отказу некоторых полицейских управлений США от использования этого инструмента.

Эти случаи – не просто наказания, а предупреждения. Этические ошибки дорого обходятся: деньгами, репутацией и доверием людей.

Регулирование: что есть сейчас и что будет дальше

- Закон ЕС об искусственном интеллекте, вступивший в силу в августе 2024 года, устанавливает строгие правила для систем ИИ высокого риска. Он требует прозрачности, человеческого надзора и оценки рисков, а за серьёзные нарушения предусмотрены штрафы до 35 млн евро или 7% от мирового дохода.

- GDPR остаётся основой защиты конфиденциальности в ЕС, требуя законных оснований для использования данных, чёткой прозрачности и защиты конфиденциальных данных, таких как биометрия и геолокация.

- В США нет единого федерального закона, как GDPR, но растёт число правоприменительных мер со стороны таких агентств, как FTC, которое борется с вводящими в заблуждение заявлениями, обманными практиками и нарушениями конфиденциальности.

Этические вызовы: предвзятость, справедливость и доверие

Помимо штрафов и регулирования, в центре дискуссий об ИИ лежат этические вопросы. Случай с Amazon Rekognition (2019) показал, насколько разрушительной может быть алгоритмическая предвзятость. Система показывала значительно более высокие показатели ошибок при идентификации женщин и людей с тёмной кожей, вызвав широкую общественную дискуссию о справедливости биометрических технологий и заставив несколько полицейских управлений США приостановить её использование. Такие примеры иллюстрируют, как предвзятость в обучающих данных может приводить к несправедливым результатам при найме на работу, выдаче кредитов или правоохранительной деятельности. В то же время, отсутствие прозрачности часто превращает ИИ в «чёрный ящик», затрудняя объяснение или аудит решений. А когда отсутствует человеческий надзор, ошибки или злоупотребления могут быстро масштабироваться, причиняя широкомасштабный вред, прежде чем кто-либо успеет вмешаться.

Создание этичного будущего для ИИ

Чтобы гарантировать, что ИИ развивается во благо человечества, компании должны закладывать в свои системы прочные этические основы. Начинается это с чёткого юридического основания для использования данных, а также полной прозрачности, чтобы пользователи понимали, что собирается и почему. Защита юных пользователей с помощью строгой проверки возраста и мер безопасности, а также непрерывный мониторинг с помощью инструментов AI-DR (AI Detection & Response) позволяют выявлять риски на ранних стадиях. В то же время, справедливость требует разнообразных обучающих данных, минимизирующих предвзятость, а соблюдение глобальных норм помогает обеспечить подотчётность систем. Но этика – это не только избегание штрафов, это обеспечение того, чтобы ИИ стал силой добра. При ответственном проектировании ИИ может расширить творческие возможности, улучшить здравоохранение, повысить качество образования и сделать повседневную жизнь проще, не подрывая доверия или человеческого достоинства. Настоящая задача – и возможность – состоит в том, чтобы создать ИИ, который работает не только для бизнеса, но и для людей и мира, в котором они живут. Эта более широкая картина также связана с политикой США – особенно с поддержкой ИИ со стороны президента, которая формирует будущие инвестиции и возможности.

Часто задаваемые вопросы (FAQ) об ИИ и этике

1. Почему этика ИИ так важна сегодня?

Потому что системы ИИ влияют на критически важные решения в здравоохранении, при найме на работу, в правоохранительной деятельности и повседневной жизни.

2. В чём главный риск неэтичного ИИ?

Сочетание предвзятости и отсутствия прозрачности – ошибки в масштабе могут причинить огромный социальный вред.

3. Какие есть реальные примеры компаний, занимающихся ИИ, которые столкнулись со штрафами?

OpenAI (15 млн евро, 2024) – за сбор данных без законных оснований.

Clearview AI (30.5 млн евро, 2024) – за создание незаконной базы биометрических данных.

Replika (5 млн евро, 2025) – за отсутствие надлежащей проверки возраста и защиты конфиденциальности.

DoNotPay (193 тыс. долларов, 2023–24) – за вводящие в заблуждение заявления о том, что является «роботом-юристом».

Amazon Rekognition (2019) – столкнулась с общественной критикой из-за сильной предвзятости в распознавании лиц.

4. Существует ли глобальное регулирование ИИ?

Пока нет. Закон ЕС об ИИ – самая комплексная структура на данный момент.

5. Что такое Закон ЕС об ИИ?

Регуляторная база, требующая прозрачности, человеческого надзора и запрещающая опасные практики, с штрафами до 35 млн евро или 7% от выручки.

6. Как компании могут снизить предвзятость ИИ?

Используя разнообразные наборы данных, проводя регулярные аудиты на предвзятость и привлекая человеческий надзор.

7. Могут ли дети безопасно пользоваться инструментами ИИ?

Да, но только при наличии строгих мер безопасности, родительского контроля и минимизации данных.

8. Какую роль FTC играет в этике ИИ?

Он обеспечивает соблюдение правил в США против вводящих в заблуждение заявлений ИИ и нарушений конфиденциальности.

9. Почему Amazon Rekognition вызвал споры?

Потому что в 2019 году он с высокой частотой ошибочно идентифицировал женщин и людей с тёмной кожей, вызывая опасения по поводу дискриминации.

10. Каково будущее этики ИИ?

Больше глобальных регуляций, усиление корпоративной ответственности и растущий спрос пользователей на доверие и прозрачность.

Смотрите также

Поддержка ИИ президентом США в 2025 году