L’intelligence artificielle est en train de tout transformer – le business, la créativité, et notre quotidien. Mais avec un grand pouvoir vient une grande responsabilité éthique. Quand les entreprises font des compromis sur la vie privée, la transparence ou l’équité, les régulateurs interviennent. Regardons ce qui se passe, qui s’est fait prendre, et comment construire une IA qui gagne la confiance au lieu des amendes.

Infractions Réelles : Ce qui s’est passé et les Sanctions

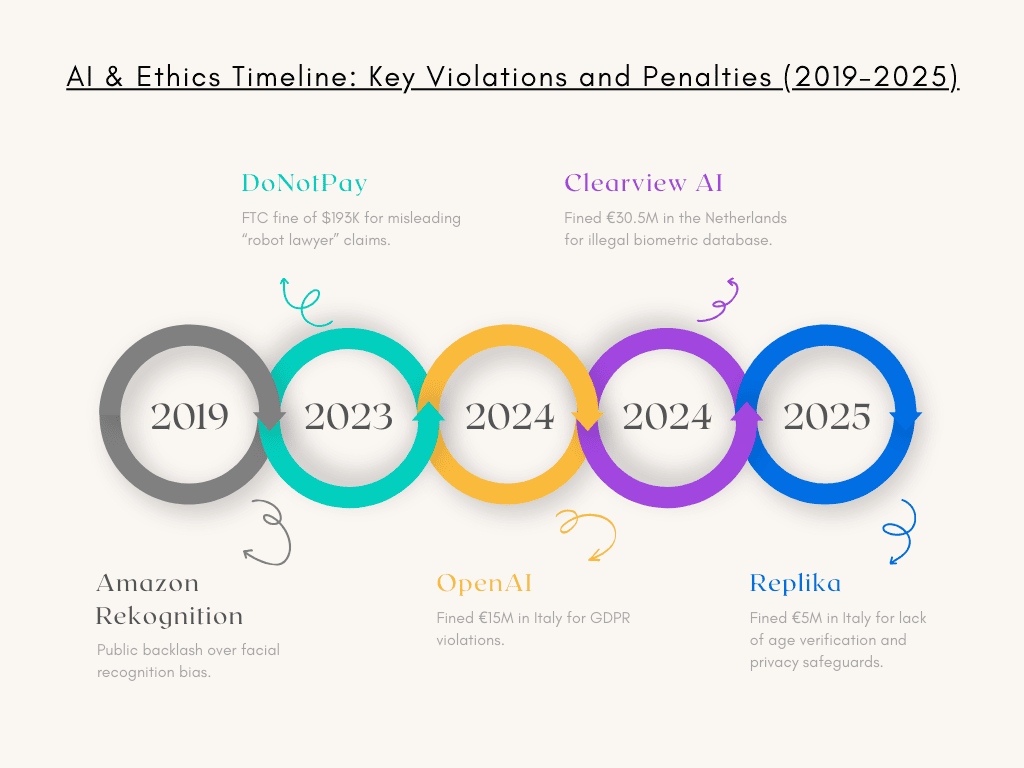

- OpenAI (2024) – condamné à une amende de 15M€ en Italie pour avoir collecté des données personnelles sans base légale appropriée et sans transparence.

- Clearview AI (2024) – condamné à une amende de 30,5M€ aux Pays-Bas pour avoir construit une base de données biométrique illégale de reconnaissance faciale récupérée sur le web.

- Replika (2025) – condamné à une amende de 5M€ en Italie pour un manque de vérification de l’âge et de protection de la vie privée.

- DoNotPay (2023–24) – condamné à une amende de 193K$ aux États-Unis pour des affirmations trompeuses sur le fait d’être un “robot avocat”.

- Amazon Rekognition (2019) – a fait face à un tollé public majeur pour des biais sévères dans sa reconnaissance faciale, identifiant mal notamment les femmes et les personnes à la peau plus foncée, ce qui a conduit certains départements de police américains à cesser d’utiliser l’outil.

Ces cas ne sont pas juste des punitions – ce sont des avertissements. Les erreurs éthiques coûtent cher, en réputation et en confiance du public.

Réglementation : Où on en est et ce qui arrive

- L’AI Act de l’UE, entré en vigueur en août 2024, établit des règles strictes pour les systèmes d’IA à haut risque. Il exige de la transparence, une supervision humaine et des évaluations des risques, avec des amendes allant jusqu’à 35M€ ou 7% du chiffre d’affaires mondial pour les violations graves.

- Le RGPD reste la base de la protection de la vie privée dans l’UE, exigeant une base légale pour l’utilisation des données, une transparence claire et la protection des données sensibles comme les données biométriques et de géolocalisation.

- Aux États-Unis, il n’y a pas de loi fédérale unique comme le RGPD, mais l’application des règles s’intensifie par le biais d’agences comme la FTC, qui cible les affirmations trompeuses, les pratiques déloyales et les violations de la vie privée.

Défis Éthiques : Biais, Équité & Confiance

Au-delà des amendes et de la réglementation, les questions éthiques sont au cœur du débat sur l’IA. Le cas d’Amazon Rekognition (2019) a montré à quel point les biais algorithmiques peuvent être dommageables. Le système présentait des taux d’erreur significativement plus élevés pour identifier les femmes et les personnes à la peau plus foncée, déclenchant un large débat public sur l’équité dans les technologies biométriques et amenant plusieurs départements de police américains à suspendre son utilisation. Ces exemples illustrent comment les biais dans les données d’entraînement peuvent entraîner des résultats inéquitables dans le recrutement, l’octroi de prêts ou l’application de la loi. Parallèlement, un manque de transparence transforme souvent l’IA en une “boîte noire”, rendant difficile l’explication ou l’audit des décisions. Et quand la supervision humaine fait défaut, les erreurs ou les abus peuvent s’amplifier rapidement, causant des dommages considérables avant que quiconque n’ait le temps d’intervenir.

Construire un Futur Éthique pour l’IA

Pour que l’IA se développe de manière à servir l’humanité, les entreprises doivent ancrer leurs systèmes sur des fondations éthiques solides. Cela commence par une base légale claire pour l’utilisation des données, ainsi qu’une transparence totale pour que les utilisateurs comprennent ce qui est collecté et pourquoi. La protection des jeunes utilisateurs grâce à une vérification de l’âge et des garanties strictes, et le maintien d’une surveillance continue avec des outils d’IA-DR (Détection et Réponse IA), permettent de repérer les risques tôt. En même temps, l’équité exige des données d’entraînement diversifiées qui minimisent les biais, tandis que le respect des réglementations mondiales aide à rendre les systèmes responsables. Mais l’éthique ne consiste pas seulement à éviter les amendes – il s’agit de s’assurer que l’IA devienne une force positive. Conçue de manière responsable, l’IA peut stimuler la créativité, améliorer la santé, l’éducation, et simplifier la vie quotidienne, sans saper la confiance ou la dignité humaine. Le véritable défi – et l’opportunité – est de construire une IA qui ne fonctionne pas seulement pour le business, mais pour les gens et le monde dans lequel ils vivent. Cette vision plus large est aussi liée à la politique américaine – en particulier le soutien présidentiel à l’IA, qui façonne les investissements et les opportunités futures.

Questions Fréquemment Posées (FAQ) sur l’IA & l’Éthique

1. Pourquoi l’éthique de l’IA est-elle si importante aujourd’hui ?

Parce que les systèmes d’IA influencent des décisions cruciales dans la santé, le recrutement, la police et la vie de tous les jours.

2. Quel est le plus grand risque d’une IA non éthique ?

La combinaison de biais et de manque de transparence – des erreurs à grande échelle peuvent causer d’énormes dommages sociaux.

3. Quels sont quelques exemples concrets d’entreprises d’IA qui ont été sanctionnées ?

OpenAI (15M€, 2024) – pour avoir collecté des données sans base légale.

Clearview AI (30,5M€, 2024) – pour avoir créé une base de données biométrique illégale.

Replika (5M€, 2025) – pour ne pas avoir mis en place une vérification de l’âge et une protection de la vie privée adéquates.

DoNotPay (193K$, 2023–24) – pour des affirmations trompeuses sur le fait d’être un “robot avocat”.

Amazon Rekognition (2019) – a fait face à un tollé public pour des biais sévères dans sa reconnaissance faciale.

4. Existe-t-il une réglementation mondiale pour l’IA ?

Pas encore. L’AI Act de l’UE est le cadre le plus complet à ce jour.

5. Qu’est-ce que l’AI Act de l’UE ?

Un cadre réglementaire exigeant la transparence, la supervision humaine et interdisant les pratiques dangereuses, avec des amendes allant jusqu’à 35M€ ou 7% du chiffre d’affaires.

6. Comment les entreprises peuvent-elles réduire les biais de l’IA ?

En utilisant des ensembles de données diversifiés, en effectuant des audits de biais réguliers et en impliquant une supervision humaine.

7. Les enfants peuvent-ils utiliser les outils d’IA en toute sécurité ?

Oui – mais seulement s’il y a des garanties strictes, des contrôles parentaux et une minimisation des données.

8. Quel rôle joue la FTC dans l’éthique de l’IA ?

Elle fait respecter les règles aux États-Unis contre les affirmations trompeuses sur l’IA et les violations de la vie privée.

9. Pourquoi Amazon Rekognition était-il controversé ?

Parce qu’en 2019, il identifiait mal les femmes et les personnes à la peau plus foncée avec des taux élevés, soulevant des inquiétudes de discrimination.

10. Quel est l’avenir de l’éthique de l’IA ?

Plus de réglementations mondiales, une plus grande responsabilité des entreprises, et une demande croissante des utilisateurs pour la confiance et la transparence.

À lire aussi

Le soutien présidentiel américain à l’IA en 2025