Η τεχνητή νοημοσύνη αλλάζει τα πάντα – επιχειρήσεις, δημιουργικότητα και την καθημερινότητά μας. Όμως, με μεγάλη δύναμη έρχεται και μεγάλη ηθική ευθύνη. Όταν οι εταιρείες κάνουν εκπτώσεις στην ιδιωτικότητα, τη διαφάνεια ή τη δικαιοσύνη, οι ρυθμιστικές αρχές παρεμβαίνουν. Ας δούμε τι συμβαίνει, ποιοι πιάστηκαν και πώς να φτιάξουμε AI που κερδίζει την εμπιστοσύνη αντί για πρόστιμα.

Πραγματικές Παραβιάσεις: Τι Συνέβη και οι Ποινές

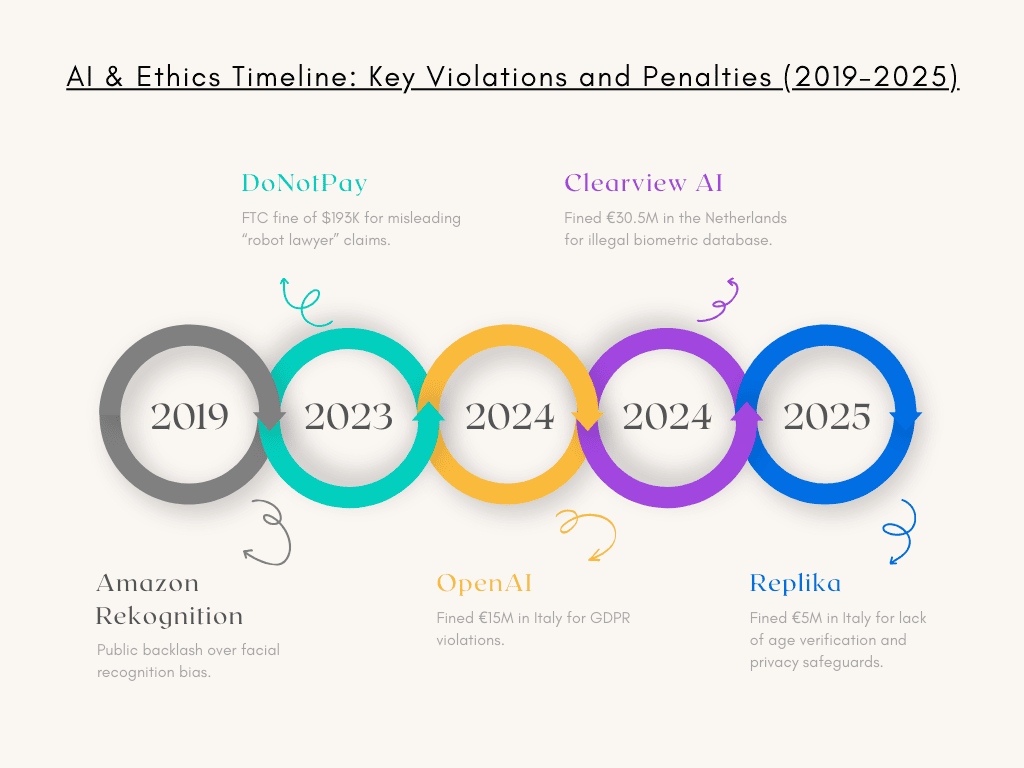

- OpenAI (2024) – πρόστιμο 15 εκατομμυρίων ευρώ στην Ιταλία για συλλογή προσωπικών δεδομένων χωρίς νόμιμη βάση και έλλειψη διαφάνειας.

- Clearview AI (2024) – πρόστιμο 30,5 εκατομμυρίων ευρώ στην Ολλανδία για τη δημιουργία παράνομης βάσης δεδομένων βιομετρικής αναγνώρισης προσώπου που συγκεντρώθηκε από το διαδίκτυο.

- Replika (2025) – πρόστιμο 5 εκατομμυρίων ευρώ στην Ιταλία για ανεπαρκή επαλήθευση ηλικίας και μέτρα προστασίας της ιδιωτικότητας.

- DoNotPay (2023–24) – πρόστιμο 193.000 δολαρίων στις ΗΠΑ για παραπλανητικούς ισχυρισμούς ότι είναι “ρομπότ δικηγόρος”.

- Amazon Rekognition (2019) – αντιμετώπισε έντονη δημόσια αντίδραση για σοβαρή μεροληψία στην αναγνώριση προσώπου, ειδικά στην αναγνώριση γυναικών και ατόμων με πιο σκούρο δέρμα, οδηγώντας ορισμένα αστυνομικά τμήματα στις ΗΠΑ να σταματήσουν τη χρήση του.

Αυτές οι περιπτώσεις είναι κάτι παραπάνω από τιμωρίες – είναι προειδοποιήσεις. Τα ηθικά λάθη κοστίζουν χρήμα, φήμη και δημόσια εμπιστοσύνη.

Ρύθμιση: Πού Βρισκόμαστε και Τι Έρχεται

- Ο Νόμος για την Τεχνητή Νοημοσύνη της ΕΕ, που τέθηκε σε ισχύ τον Αύγουστο του 2024, θέτει αυστηρούς κανόνες για συστήματα AI υψηλού κινδύνου. Απαιτεί διαφάνεια, ανθρώπινη εποπτεία και αξιολογήσεις κινδύνου, με πρόστιμα έως και 35 εκατομμύρια ευρώ ή 7% του παγκόσμιου κύκλου εργασιών για σοβαρές παραβιάσεις.

- Ο GDPR παραμένει το θεμέλιο της ιδιωτικότητας στην ΕΕ, απαιτώντας νόμιμη βάση για τη χρήση δεδομένων, σαφή διαφάνεια και προστασία ευαίσθητων δεδομένων όπως βιομετρικά και γεωγραφικές τοποθεσίες.

- Στις ΗΠΑ, δεν υπάρχει ενιαίος ομοσπονδιακός νόμος όπως ο GDPR, αλλά η επιβολή αυξάνεται μέσω φορέων όπως η FTC, η οποία στοχεύει σε παραπλανητικούς ισχυρισμούς, εξαπατητικές πρακτικές και παραβιάσεις της ιδιωτικότητας (FTC).

Ηθικές Προκλήσεις: Μεροληψία, Δικαιοσύνη & Εμπιστοσύνη

Πέρα από τα πρόστιμα και τους κανονισμούς, τα ηθικά ερωτήματα βρίσκονται στον πυρήνα της συζήτησης για την AI. Η περίπτωση του Amazon Rekognition (2019) αποκάλυψε πόσο καταστροφική μπορεί να είναι η αλγοριθμική μεροληψία. Το σύστημα έδειξε σημαντικά υψηλότερα ποσοστά σφάλματος στην αναγνώριση γυναικών και ατόμων με πιο σκούρο δέρμα, πυροδοτώντας μια ευρεία δημόσια συζήτηση για τη δικαιοσύνη στις βιομετρικές τεχνολογίες και οδηγώντας αρκετά αστυνομικά τμήματα στις ΗΠΑ να αναστείλουν τη χρήση του. Τέτοια παραδείγματα δείχνουν πώς η μεροληψία στα δεδομένα εκπαίδευσης μπορεί να οδηγήσει σε άδικα αποτελέσματα στην πρόσληψη, τη χορήγηση δανείων ή την επιβολή του νόμου. Ταυτόχρονα, η έλλειψη διαφάνειας συχνά μετατρέπει την AI σε ένα “μαύρο κουτί”, καθιστώντας δύσκολο να εξηγηθούν ή να ελεγχθούν οι αποφάσεις. Και όταν λείπει η ανθρώπινη εποπτεία, τα λάθη ή η κακή χρήση μπορούν να κλιμακωθούν γρήγορα, προκαλώντας εκτεταμένη ζημιά πριν καν κάποιος προλάβει να παρέμβει.

Δημιουργώντας ένα Ηθικό Μέλλον για την AI

Για να διασφαλιστεί ότι η AI αναπτύσσεται με τρόπους που εξυπηρετούν την ανθρωπότητα, οι εταιρείες πρέπει να θεμελιώνουν τα συστήματά τους σε ισχυρά ηθικά θεμέλια. Αυτό ξεκινά με μια σαφή νομική βάση για τη χρήση δεδομένων, μαζί με πλήρη διαφάνεια ώστε οι χρήστες να κατανοούν τι συλλέγεται και γιατί. Η προστασία των νεότερων χρηστών μέσω αυστηρής επαλήθευσης ηλικίας και προστατευτικών μέτρων, και η διατήρηση συνεχούς παρακολούθησης με εργαλεία AI-DR (AI Detection & Response), διασφαλίζει ότι οι κίνδυνοι εντοπίζονται νωρίς. Ταυτόχρονα, η δικαιοσύνη απαιτεί ποικίλα σύνολα δεδομένων εκπαίδευσης που ελαχιστοποιούν τη μεροληψία, ενώ η ευθυγράμμιση με τους παγκόσμιους κανονισμούς βοηθά στη διατήρηση της λογοδοσίας των συστημάτων. Αλλά η ηθική δεν αφορά μόνο την αποφυγή προστίμων – αφορά τη διασφάλιση ότι η AI γίνεται δύναμη για το καλό. Όταν σχεδιάζεται υπεύθυνα, η AI μπορεί να ενισχύσει τη δημιουργικότητα, να βελτιώσει την υγεία, να αναβαθμίσει την εκπαίδευση και να κάνει την καθημερινή ζωή πιο ομαλή, όλα αυτά χωρίς να υπονομεύεται η εμπιστοσύνη ή η ανθρώπινη αξιοπρέπεια. Η πραγματική πρόκληση – και ευκαιρία – είναι να δημιουργήσουμε AI που δεν λειτουργεί μόνο για τις επιχειρήσεις, αλλά λειτουργεί για τους ανθρώπους και τον κόσμο στον οποίο ζουν. Αυτή η ευρύτερη εικόνα συνδέεται επίσης με την πολιτική των ΗΠΑ – ειδικά με την προεδρική υποστήριξη για την AI, η οποία διαμορφώνει μελλοντικές επενδύσεις και ευκαιρίες.

Συχνές Ερωτήσεις (FAQ) για την AI & την Ηθική

1. Γιατί η ηθική της AI είναι τόσο σημαντική σήμερα;

Επειδή τα συστήματα AI επηρεάζουν κρίσιμες αποφάσεις στην υγεία, την πρόσληψη, την επιβολή του νόμου και την καθημερινή ζωή.

2. Ποιος είναι ο μεγαλύτερος κίνδυνος από την ανήθικη AI;

Ο συνδυασμός μεροληψίας και έλλειψης διαφάνειας – τα κλιμακούμενα λάθη μπορούν να προκαλέσουν τεράστια κοινωνική ζημιά.

3. Ποια είναι μερικά παραδείγματα εταιρειών AI που αντιμετώπισαν ποινές;

OpenAI (15 εκατ. €, 2024) – για συλλογή δεδομένων χωρίς νόμιμη βάση.

Clearview AI (30,5 εκατ. €, 2024) – για δημιουργία παράνομης βάσης δεδομένων αναγνώρισης προσώπου.

Replika (5 εκατ. €, 2025) – για αδυναμία εφαρμογής σωστής επαλήθευσης ηλικίας και ιδιωτικότητας.

DoNotPay (193.000 $, 2023–24) – για παραπλανητικούς ισχυρισμούς ότι είναι “ρομπότ δικηγόρος”.

Amazon Rekognition (2019) – αντιμετώπισε δημόσια αντίδραση για σοβαρή μεροληψία στην αναγνώριση προσώπου.

4. Υπάρχει παγκόσμια ρύθμιση για την AI;

Όχι ακόμα. Ο Νόμος για την AI της ΕΕ είναι το πιο ολοκληρωμένο πλαίσιο μέχρι στιγμής.

5. Τι είναι ο Νόμος για την AI της ΕΕ;

Ένα ρυθμιστικό πλαίσιο που απαιτεί διαφάνεια, ανθρώπινη εποπτεία και απαγορεύει επικίνδυνες πρακτικές, με πρόστιμα έως 35 εκατομμύρια ευρώ ή 7% του κύκλου εργασιών.

6. Πώς μπορούν οι εταιρείες να μειώσουν τη μεροληψία της AI;

Χρησιμοποιώντας ποικίλα σύνολα δεδομένων, πραγματοποιώντας τακτικούς ελέγχους μεροληψίας και εμπλέκοντας ανθρώπινη εποπτεία.

7. Μπορούν τα παιδιά να χρησιμοποιούν με ασφάλεια εργαλεία AI;

Ναι – αλλά μόνο αν υπάρχουν αυστηρά προστατευτικά μέτρα, γονικός έλεγχος και ελαχιστοποίηση δεδομένων.

8. Τι ρόλο παίζει η FTC στην ηθική της AI;

Επιβάλλει κανόνες στις ΗΠΑ κατά παραπλανητικών ισχυρισμών AI και παραβιάσεων της ιδιωτικότητας.

9. Γιατί το Amazon Rekognition ήταν αμφιλεγόμενο;

Επειδή το 2019 ανέφερε λανθασμένα γυναίκες και άτομα με πιο σκούρο δέρμα σε υψηλά ποσοστά, εγείροντας ανησυχίες για διακρίσεις.

10. Ποιο είναι το μέλλον της ηθικής της AI;

Περισσότεροι παγκόσμιοι κανονισμοί, ισχυρότερη εταιρική λογοδοσία και αυξανόμενη ζήτηση από τους χρήστες για εμπιστοσύνη και διαφάνεια.

Σχετική Ανάγνωση

Προεδρική Υποστήριξη των ΗΠΑ για την AI το 2025

Αυτόνομα AI Agents: Η Αυγή της Αυτόματης Νοημοσύνης

Πώς η Τεχνητή Νοημοσύνη Αναδιαμορφώνει την Αγορά Εργασίας το 2025