الذكاء الاصطناعي (Artificial Intelligence – AI) يغير كل شيء – الأعمال، الإبداع، والحياة اليومية. لكن مع قوة عظيمة تأتي مسؤولية أخلاقية. عندما تختصر الشركات الطريق في الخصوصية (privacy)، الشفافية (transparency)، أو العدالة (fairness)، تتدخل الجهات التنظيمية. دعونا نلقي نظرة على ما يحدث، ومن وقع في المشاكل، وكيف نبني ذكاء اصطناعياً يكتسب الثقة بدلاً من الغرامات.

انتهاكات حقيقية: ماذا حدث والعقوبات

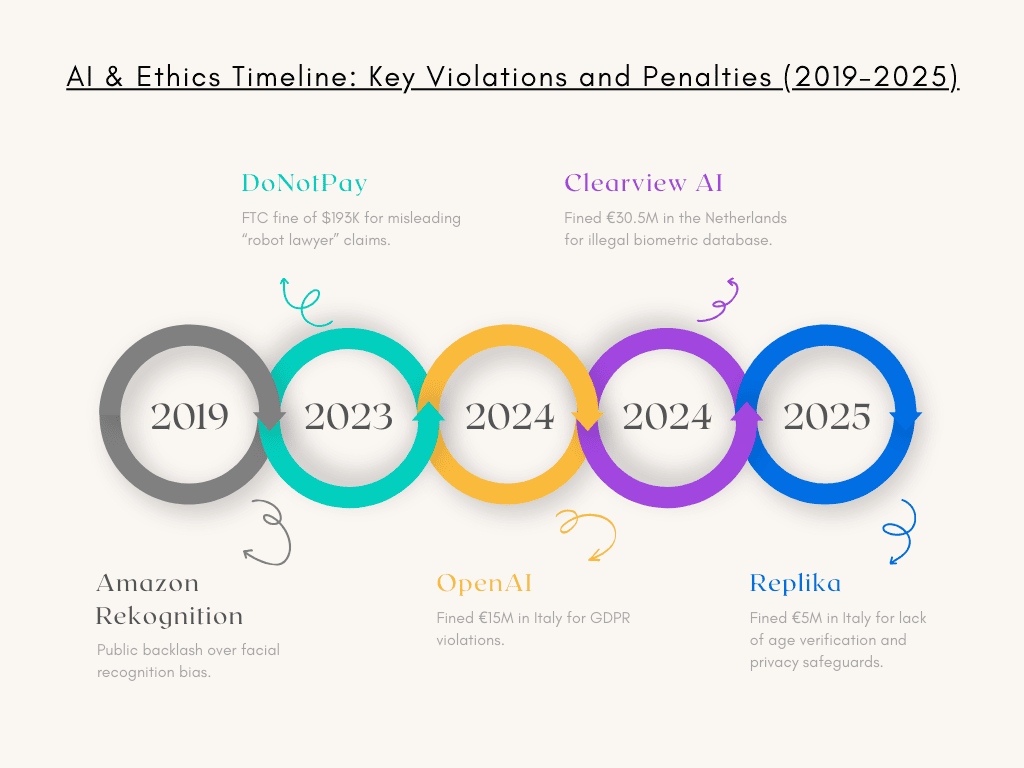

- OpenAI (2024) – غُرّمت 15 مليون يورو في إيطاليا لجمع بيانات شخصية دون أساس قانوني سليم وعدم وجود شفافية.

- Clearview AI (2024) – غُرّمت 30.5 مليون يورو في هولندا لبناء قاعدة بيانات غير قانونية للتعرف على الوجوه البيومترية تم جمعها من الويب.

- Replika (2025) – غُرّمت 5 ملايين يورو في إيطاليا لعدم كفاية التحقق من العمر وضمانات الخصوصية.

- DoNotPay (2023–24) – غُرّمت 193 ألف دولار في الولايات المتحدة لادعاءات مضللة حول كونها “محامي آلي”.

- Amazon Rekognition (2019) – واجهت انتقادات عامة واسعة بسبب التحيز الشديد في التعرف على الوجوه، خاصةً تحديد النساء والأشخاص ذوي البشرة الداكنة بشكل خاطئ، مما دفع بعض إدارات الشرطة الأمريكية إلى التوقف عن استخدام الأداة.

هذه القضايا ليست مجرد عقوبات – إنها تحذيرات. الأخطاء الأخلاقية تكلف المال، السمعة، وثقة الجمهور.

التنظيم: الوضع الحالي وما هو قادم

- قانون الذكاء الاصطناعي للاتحاد الأوروبي، الذي دخل حيز التنفيذ في أغسطس 2024، يضع قواعد صارمة لأنظمة الذكاء الاصطناعي عالية المخاطر. يتطلب الشفافية، الإشراف البشري، وتقييمات المخاطر، مع غرامات تصل إلى 35 مليون يورو أو 7% من الإيرادات العالمية للانتهاكات الخطيرة.

- اللائحة العامة لحماية البيانات (GDPR) تظل الأساس للخصوصية في الاتحاد الأوروبي، وتتطلب أساساً قانونياً لاستخدام البيانات، شفافية واضحة، وحماية البيانات الحساسة مثل البيانات البيومترية وبيانات تحديد الموقع الجغرافي.

- في الولايات المتحدة، لا يوجد قانون فيدرالي واحد مثل اللائحة العامة لحماية البيانات، ولكن الإنفاذ يتزايد من خلال وكالات مثل لجنة التجارة الفيدرالية (FTC)، التي تستهدف الادعاءات المضللة، الممارسات الخادعة، وانتهاكات الخصوصية.

التحديات الأخلاقية: التحيز، العدالة، والثقة

بعيداً عن الغرامات والتنظيم، تقع الأسئلة الأخلاقية في صميم النقاش حول الذكاء الاصطناعي. قضية Amazon Rekognition (2019) كشفت مدى الضرر الذي يمكن أن يسببه التحيز الخوارزمي. أظهر النظام معدلات خطأ أعلى بكثير في تحديد النساء والأشخاص ذوي البشرة الداكنة، مما أثار نقاشاً عاماً واسعاً حول العدالة في التقنيات البيومترية ودفع العديد من إدارات الشرطة الأمريكية إلى تعليق استخدامه. توضح أمثلة كهذه كيف يمكن أن يؤدي التحيز في بيانات التدريب إلى نتائج غير عادلة في التوظيف، الإقراض، أو إنفاذ القانون. في الوقت نفسه، غالباً ما يحول نقص الشفافية الذكاء الاصطناعي إلى “صندوق أسود”، مما يجعل من الصعب شرح القرارات أو تدقيقها. وعندما يغيب الإشراف البشري، يمكن للأخطاء أو سوء الاستخدام أن يتوسع بسرعة، مسبباً ضرراً واسع النطاق قبل أن تتاح الفرصة لأحد للتدخل.

بناء مستقبل أخلاقي للذكاء الاصطناعي

لضمان تطور الذكاء الاصطناعي بطرق تخدم البشرية، يجب على الشركات أن ترتكز أنظمتها على أسس أخلاقية قوية. يبدأ ذلك بوجود أساس قانوني واضح لاستخدام البيانات، جنباً إلى جنب مع شفافية كاملة ليفهم المستخدمون ما يتم جمعه ولماذا. حماية المستخدمين الأصغر سناً من خلال التحقق الصارم من العمر والضمانات، والحفاظ على مراقبة مستمرة باستخدام أدوات AI-DR (AI Detection & Response)، تضمن اكتشاف المخاطر مبكراً. في الوقت نفسه، تتطلب العدالة بيانات تدريب متنوعة تقلل من التحيز، بينما يساعد البقاء متوافقاً مع اللوائح العالمية في الحفاظ على مساءلة الأنظمة. لكن الأخلاقيات ليست فقط حول تجنب الغرامات – إنها حول ضمان أن يصبح الذكاء الاصطناعي قوة للخير. عند تصميمه بمسؤولية، يمكن للذكاء الاصطناعي تمكين الإبداع، تحسين الرعاية الصحية، تعزيز التعليم، وجعل الحياة اليومية أكثر سلاسة، كل ذلك دون تقويض الثقة أو الكرامة الإنسانية. التحدي الحقيقي – والفرصة – هو بناء ذكاء اصطناعي لا يعمل فقط من أجل الأعمال، بل يعمل من أجل الناس والعالم الذي يعيشون فيه. هذه الصورة الأوسع تربطنا أيضاً بالسياسة الأمريكية – وخاصة الدعم الرئاسي للذكاء الاصطناعي، الذي يشكل الاستثمارات والفرص المستقبلية.

أسئلة شائعة (FAQ) حول الذكاء الاصطناعي والأخلاقيات

1. لماذا تعتبر أخلاقيات الذكاء الاصطناعي مهمة جداً اليوم؟

لأن أنظمة الذكاء الاصطناعي تؤثر على القرارات الحاسمة في الرعاية الصحية، التوظيف، إنفاذ القانون، والحياة اليومية.

2. ما هو أكبر خطر للذكاء الاصطناعي غير الأخلاقي؟

مزيج التحيز ونقص الشفافية – الأخطاء المتوسعة يمكن أن تسبب ضرراً اجتماعياً هائلاً.

3. ما هي بعض الأمثلة الواقعية لشركات الذكاء الاصطناعي التي واجهت عقوبات؟

OpenAI (15 مليون يورو، 2024) – لجمع البيانات دون أساس قانوني.

Clearview AI (30.5 مليون يورو، 2024) – لإنشاء قاعدة بيانات بيومترية غير قانونية.

Replika (5 ملايين يورو، 2025) – لفشلها في تطبيق التحقق من العمر المناسب وخصوصية البيانات.

DoNotPay (193 ألف دولار، 2023–24) – لادعاءات مضللة بأنها “محامي آلي”.

Amazon Rekognition (2019) – واجهت انتقادات عامة بسبب التحيز الشديد في التعرف على الوجوه.

4. هل هناك تنظيم عالمي للذكاء الاصطناعي؟

ليس بعد. قانون الذكاء الاصطناعي للاتحاد الأوروبي هو الإطار الأكثر شمولاً حتى الآن.

5. ما هو قانون الذكاء الاصطناعي للاتحاد الأوروبي؟

إطار تنظيمي يتطلب الشفافية، الإشراف البشري، ويحظر الممارسات الخطيرة، مع غرامات تصل إلى 35 مليون يورو أو 7% من الإيرادات.

6. كيف يمكن للشركات تقليل تحيز الذكاء الاصطناعي؟

باستخدام مجموعات بيانات متنوعة، إجراء عمليات تدقيق منتظمة للتحيز، وإشراك الإشراف البشري.

7. هل يمكن للأطفال استخدام أدوات الذكاء الاصطناعي بأمان؟

نعم – ولكن فقط إذا كانت هناك ضمانات صارمة، ضوابط أبوية، وتقليل للبيانات.

8. ما هو دور لجنة التجارة الفيدرالية (FTC) في أخلاقيات الذكاء الاصطناعي؟

إنها تطبق القواعد في الولايات المتحدة ضد الادعاءات المضللة للذكاء الاصطناعي وانتهاكات الخصوصية.

9. لماذا كانت Amazon Rekognition مثيرة للجدل؟

لأنها في عام 2019 حددت النساء والأشخاص ذوي البشرة الداكنة بشكل خاطئ بمعدلات عالية، مما أثار مخاوف التمييز.

10. ما هو مستقبل أخلاقيات الذكاء الاصطناعي؟

المزيد من اللوائح العالمية، مساءلة أقوى للشركات، وزيادة طلب المستخدمين على الثقة والشفافية.

قراءات ذات صلة

الدعم الرئاسي الأمريكي للذكاء الاصطناعي في 2025