لماذا يدعم البيت الأبيض الذكاء الاصطناعي؟

الإدارة الأمريكية الحالية ترى في الذكاء الاصطناعي (artificial intelligence – AI) رافعة استراتيجية للنمو الاقتصادي، والأمن القومي، والقدرة التنافسية العالمية. خطة العمل الأمريكية للذكاء الاصطناعي (America’s AI Action Plan) تضع خارطة طريق وطنية للابتكار، والمهارات، والبنية التحتية — وتؤكد بشكل صريح على أن الذكاء الاصطناعي مجال يجب أن تقوده الولايات المتحدة.

كيف يدعم الرئيس الذكاء الاصطناعي؟

1) قرارات تنفيذية واستراتيجية وطنية

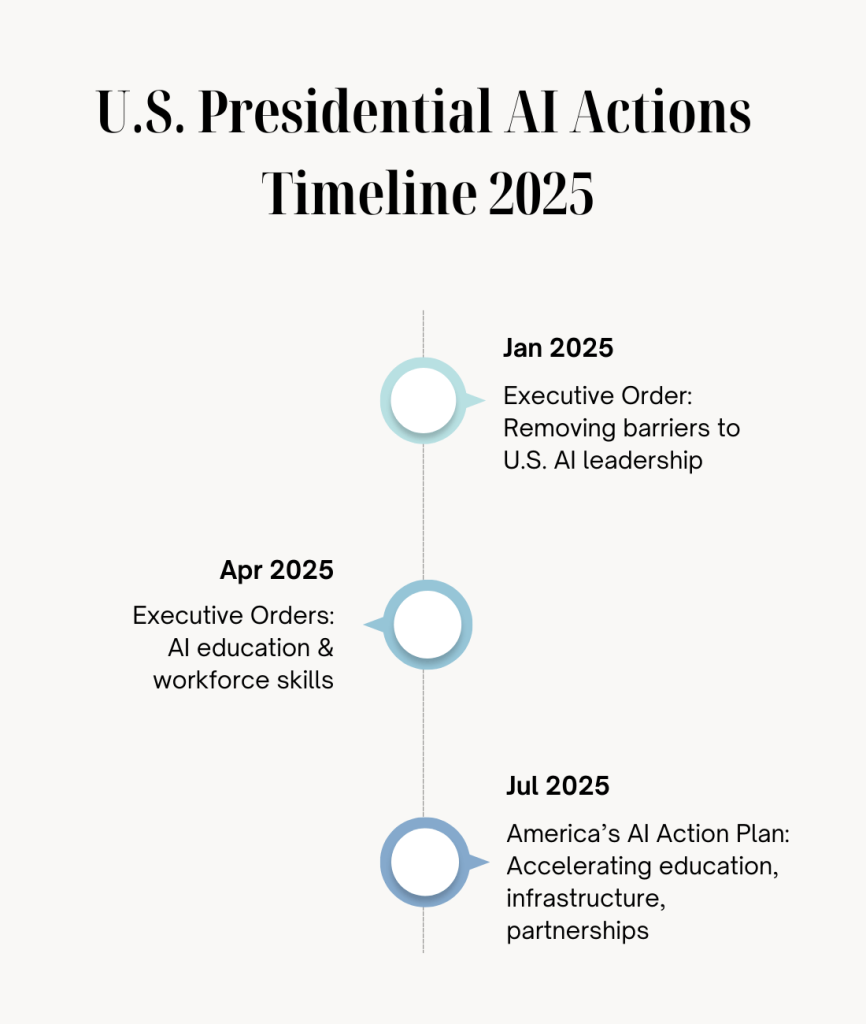

- خطة العمل الأمريكية للذكاء الاصطناعي (يوليو 2025): توجه الوكالات الفيدرالية لتسريع تعليم الذكاء الاصطناعي، وتعزيز البنية التحتية المحلية، وتوسيع الشراكات بين القطاعين العام والخاص، مع الحماية ضد استخدامات الذكاء الاصطناعي “الأورويلية”.

- أمر تنفيذي لـ “إزالة الحواجز” أمام ريادة الولايات المتحدة في مجال الذكاء الاصطناعي (يناير 2025): يشير إلى توجه نحو تقليل القيود وتعزيز الابتكار عبر الوكالات الفيدرالية.

- أوامر تنفيذية للتعليم والقوى العاملة (أبريل 2025): تشير خطة العمل إلى أوامر تنفيذية جديدة تركز على تعليم الذكاء الاصطناعي للشباب والمهارات اللازمة لوظائف المستقبل.

2) استدعاء صناعة التكنولوجيا

الرئيس وكبار موظفيه يتفاعلون بنشاط مع قادة التكنولوجيا الكبار (Apple, Meta, Microsoft, Google, OpenAI وغيرهم) في البيت الأبيض لتحديد أولويات مشتركة في تعليم الذكاء الاصطناعي، والابتكار، والسياسات — وهي اجتماعات ذات ظهور قوي تعكس أيضاً ثقة السوق.

3) البنية التحتية للمعايير والمخاطر والسلامة

بدلاً من إيقاف الابتكار، تعتمد الهيئات الفيدرالية على إطار إدارة مخاطر الذكاء الاصطناعي (AI Risk Management Framework – AI RMF) من المعهد الوطني للمعايير والتكنولوجيا (NIST) وملفاته الجديدة لتوجيه النشر الآمن عبر الحكومة والصناعة — وهو نهج يفضل ضوابط المخاطر العملية بدلاً من الحظر الصريح.

شدد البيت الأبيض على أهمية تطوير معايير واضحة وإطار قوي لإدارة المخاطر لتوجيه النشر الآمن للذكاء الاصطناعي. هذا النهج يفضل ضوابط المخاطر العملية بدلاً من الحظر الصريح، ويتماشى مع المناقشات العالمية الأوسع حول الذكاء الاصطناعي المسؤول ويضمن استمرار الابتكار مع الحفاظ على ثقة الجمهور.

4) المشتريات الفيدرالية والتجارب

يتم تشجيع الوكالات على تبني الذكاء الاصطناعي التجاري المثبت. شراكات مثل Palantir + Accenture Federal Services تهدف إلى تقديم دعم اتخاذ القرار المدعوم بالذكاء الاصطناعي “في نسيج الوكالات الحكومية”، مما يسرع حالات الاستخدام الواقعية.

5) المشاركة التشريعية

في الكابيتول هيل، تشير إجراءات مثل قانون CREATE AI لعام 2025 (لتوسيع موارد البحث الوطنية في مجال الذكاء الاصطناعي) إلى وجود زخم ثنائي الحزب لتمويل الحوسبة، والبيانات، والوصول إلى البحث — مما يكمل الإجراءات التنفيذية. الولايات أيضاً تتحرك بسرعة، مع عشرات الإجراءات الجديدة المتعلقة بالذكاء الاصطناعي في عام 2025.

كيف تدعم الإدارة الذكاء الاصطناعي عملياً

- التمويل والحوافز: إعطاء الأولوية للبنية التحتية ذات الصلة بالذكاء الاصطناعي في الميزانيات الفيدرالية وتشجيع النفقات الرأسمالية الخاصة من خلال التزامات المشتريات.

- المعايير والإرشادات: توسيع تبني إطار إدارة مخاطر الذكاء الاصطناعي (AI RMF) عبر الوكالات؛ نشر ملفات تعريف خاصة بمجالات محددة (مثل الذكاء الاصطناعي التوليدي والنشر مع مراعاة حقوق الإنسان).

- المواهب والمهارات: توسيع برامج تعليم الذكاء الاصطناعي وتنمية القوى العاملة (للشباب، والمهن، وتنمية المهارات) عبر التوجيهات التنفيذية والتنسيق بين الوكالات.

- التجارب بين القطاعين العام والخاص: استخدام اتفاقيات أخرى (OTAs)، ومرونة قواعد المشتريات الفيدرالية (FAR)، وبرامج التحدي لتجربة أنظمة الذكاء الاصطناعي في مجالات الدفاع، والصحة، واللوجستيات، وخدمات المواطنين (مثل الشراكة الفيدرالية بين Palantir و AFS).

اجتماعات الصناعة: الحفاظ على حوار منظم مع الرؤساء التنفيذيين والباحثين لتحديد أولويات مشتركة حول الحوسبة، والسلامة، وعقبات النشر.

لماذا هذا الدعم مهم

- القدرة التنافسية العالمية: الاستراتيجية الوطنية + تنسيق الوكالات يقللان من احتكاكات السياسة، مما يسرع وقت الوصول إلى السوق للاختراقات والبنيه التحتية في مجال الذكاء الاصطناعي.

- سلامة عملية: استخدام إطار إدارة مخاطر الذكاء الاصطناعي (AI RMF) يبني لغة مشتركة للمخاطر دون خنق الابتكار، مما يوفر للشركات ضوابط واضحة.

- الحكومة كعميل رائد: المشتريات الفيدرالية تصادق على منتجات الذكاء الاصطناعي وتحفز التبني الأوسع عبر الاقتصاد.

تأثيرات دولية

غالباً ما تحدد مكانة الولايات المتحدة المعايير العالمية. تركيز البيت الأبيض على الابتكار مع إدارة المخاطر — المدعوم بتوجيهات NIST — يدفع الحلفاء والشركاء نحو معايير متوافقة وأنظمة ضمان قابلة للتشغيل المتبادل. الدول التي تتابع سياسة الولايات المتحدة (والبائعين المقيمين في الولايات المتحدة) من المرجح أن تعكس عناصر من إدارة المخاطر بأسلوب إطار إدارة مخاطر الذكاء الاصطناعي (RMF)، وتعزز تمويلها الخاص للذكاء الاصطناعي، وتستقطب الشركات الأمريكية للمشاريع المشتركة وبناء مراكز البيانات.

سياسات الإدارة تثير بالفعل تأثيرات دولية، حيث تتبع الدول مبادرات الولايات المتحدة وتعزز استثماراتها في الذكاء الاصطناعي. هذا يسلط الضوء على كيف يمكن للقيادة الأمريكية تشكيل المعايير وتسريع التبني، مما يدفع تأثير الذكاء الاصطناعي الواسع عبر القطاعات، من الرعاية الصحية إلى التصنيع.

خاتمة: ماذا نتوقع لاحقاً

نهج الإدارة — الذي يجمع بين إشارات تقليل القيود والتوجيه التنفيذي مع ممارسات السلامة المرتكزة على NIST والمشاركة المكثفة مع الصناعة — يشير إلى أن الولايات المتحدة ستقوم بتوسيع نطاق نشر الذكاء الاصطناعي عبر الوكالات مع استقطاب الاستثمار الخاص في الحوسبة، ومراكز البيانات، والنماذج. توقعوا تجارب فيدرالية موسعة، ومبادرات إضافية لتعليم الذكاء الاصطناعي، وتنسيقاً أوثق مع الحلفاء بشأن المعايير. من المرجح أن تستجيب الحكومات الأخرى بخططها الاستثمارية وأطر المخاطر الخاصة بها، مما يخلق منافسة في الأساليب بحكم الأمر الواقع — ولكن مع قابلية تشغيل متبادل متزايدة حيثما يصبح إطار إدارة مخاطر الذكاء الاصطناعي الأمريكي (AI RMF) هو العمود الفقري المشترك.

الذكاء الاصطناعي والبيت الأبيض: أسئلة رئيسية مجابة

ما هي خطة العمل الأمريكية للذكاء الاصطناعي؟

خطة العمل الأمريكية للذكاء الاصطناعي هي خارطة طريق وطنية أطلقها البيت الأبيض في عام 2025 لتوسيع تعليم الذكاء الاصطناعي، وتعزيز البنية التحتية، ودفع الابتكار مع معالجة المخاطر.

لماذا يدعم الرئيس الأمريكي الذكاء الاصطناعي؟

ترى الإدارة أن الذكاء الاصطناعي ضروري لـ النمو الاقتصادي، والأمن القومي، والقدرة التنافسية العالمية، مما يجعل الدعم الفيدرالي أساسياً للريادة.

كيف يتعاون البيت الأبيض مع شركات التكنولوجيا الكبرى بشأن الذكاء الاصطناعي؟

يجتمع الرئيس بانتظام مع قادة من Apple, Meta, Microsoft, Google, و OpenAI لتحديد أولويات مشتركة في الابتكار، والسياسات، والتعليم المتعلق بالذكاء الاصطناعي.

ما هو دور المعهد الوطني للمعايير والتكنولوجيا (NIST) في تنظيم الذكاء الاصطناعي؟

يقدم إطار إدارة مخاطر الذكاء الاصطناعي (AI RMF) من NIST معايير للنشر الآمن للذكاء الاصطناعي، موازناً بين الابتكار وضوابط المخاطر العملية.

ما هي الوكالات الفيدرالية التي تتبنى الذكاء الاصطناعي في عام 2025؟

وكالات في مجالات الدفاع، والرعاية الصحية، واللوجستيات، وخدمات المواطنين تقوم بتجربة حلول الذكاء الاصطناعي من خلال شراكات مع شركات مثل Palantir و Accenture Federal Services.

لماذا تعتبر سياسة الذكاء الاصطناعي الأمريكية مهمة عالمياً؟

لأن المعايير والسياسات الأمريكية غالباً ما تحدد معايير عالمية، وتشكل كيفية تبني الحلفاء والشركاء لأطر الذكاء الاصطناعي وممارسات إدارة المخاطر.

قراءات ذات صلة

الذكاء الاصطناعي والأخلاقيات: القواعد، الانتهاكات، وما يبدو عليه الذكاء الاصطناعي المسؤول

زيادة استثمارات عمالقة التكنولوجيا في الذكاء الاصطناعي في 2025