La inteligencia artificial está transformando todo: negocios, creatividad y la vida diaria. Pero con un gran poder viene una gran responsabilidad ética. Cuando las empresas se saltan la privacidad, la transparencia o la equidad, los reguladores entran en acción. Veamos qué está pasando, quién se metió en problemas y cómo crear una IA que genere confianza en lugar de multas.

Infracciones Reales: Qué Sucedió y las Sanciones

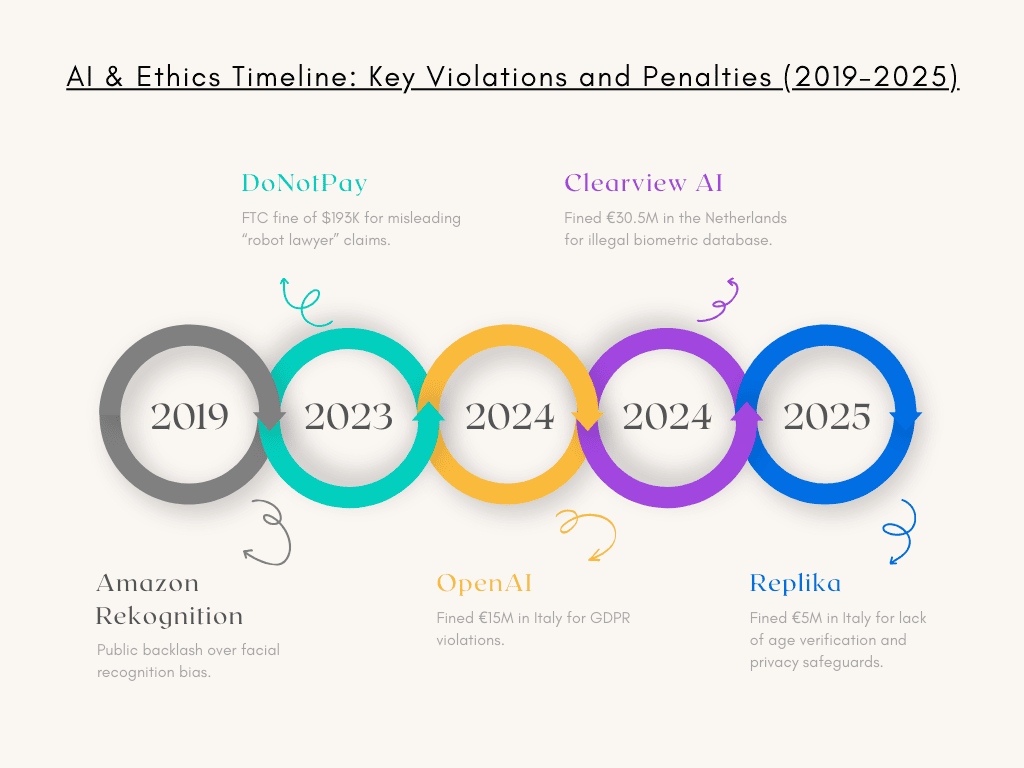

- OpenAI (2024) — multada con 15M€ en Italia por recopilar datos personales sin una base legal adecuada y por falta de transparencia.

- Clearview AI (2024) — multada con 30.5M€ en los Países Bajos por crear una base de datos biométrica de reconocimiento facial ilegal extraída de la web.

- Replika (2025) — multada con 5M€ en Italia por verificación de edad y salvaguardas de privacidad insuficientes.

- DoNotPay (2023–24) — multada con $193K en EE.UU. por afirmaciones engañosas sobre ser un “abogado robot”.

- Amazon Rekognition (2019) — enfrentó una fuerte reacción pública por un grave sesgo en el reconocimiento facial, identificando erróneamente a mujeres y personas de piel oscura, lo que llevó a algunos departamentos de policía de EE.UU. a dejar de usar la tool.

Estos casos son más que castigos, son advertencias. Los errores éticos cuestan dinero, reputación y la confianza del público.

Regulación: Dónde Estamos y Qué Viene

- La Ley de Inteligencia Artificial de la UE, que entró en vigor en agosto de 2024, establece reglas estrictas para los sistemas de IA de alto riesgo. Requiere transparencia, supervisión humana y evaluaciones de riesgos, con multas de hasta 35M€ o el 7% de los ingresos globales por violaciones graves.

- El GDPR sigue siendo la base para la privacidad en la UE, requiriendo una base legal para el uso de datos, transparencia clara y protección de datos sensibles como datos biométricos y geolocalización.

- En EE.UU., no hay una ley federal única como el GDPR, pero la aplicación está aumentando a través de agencias como la FTC, que se enfoca en afirmaciones engañosas, prácticas de engaño y violaciones de privacidad (FTC).

Desafíos Éticos: Sesgo, Equidad y Confianza

Más allá de las multas y la regulación, las cuestiones éticas están en el centro del debate de la IA. El caso de Amazon Rekognition (2019) reveló cuán dañino puede ser el sesgo algorítmico. El sistema mostró tasas de error significativamente más altas al identificar mujeres y personas de piel oscura, lo que generó un amplio debate público sobre la equidad en las tecnologías biométricas y llevó a varios departamentos de policía de EE.UU. a suspender su uso. Estos ejemplos ilustran cómo el sesgo en los datos de entrenamiento puede resultar en resultados injustos en contratación, préstamos o aplicación de la ley. Al mismo tiempo, la falta de transparencia a menudo convierte a la IA en una “caja negra”, dificultando la explicación o auditoría de las decisiones. Y cuando falta la supervisión humana, los errores o el mal uso pueden escalar rápidamente, causando daños generalizados antes de que alguien tenga la oportunidad de intervenir.

Construyendo un Futuro Ético para la IA

Para asegurar que la IA se desarrolle de maneras que sirvan a la humanidad, las empresas deben basar sus sistemas en sólidos cimientos éticos. Eso comienza con una clara base legal para el uso de datos, junto con total transparencia para que los usuarios entiendan qué se recopila y por qué. Proteger a los usuarios jóvenes a través de una estricta verificación de edad y salvaguardas, y mantener un monitoreo continuo con tools de IA-DR (Detección y Respuesta de IA), asegura que los riesgos se detecten a tiempo. Al mismo tiempo, la equidad requiere datos de entrenamiento diversos que minimicen el sesgo, mientras que mantenerse alineado con las regulaciones globales ayuda a mantener los sistemas responsables. Pero la ética no se trata solo de evitar multas, se trata de asegurar que la IA se convierta en una fuerza para el bien. Cuando se diseña de forma responsable, la IA puede potenciar la creatividad, mejorar la atención médica, la educación y hacer la vida diaria más fluida, todo sin socavar la confianza o la dignidad humana. El verdadero desafío — y oportunidad — es construir una IA que no solo funcione para los negocios, sino que funcione para las personas y el mundo en que viven. Este panorama más amplio también se conecta con la política de EE.UU. — particularmente el apoyo presidencial a la IA, que está moldeando las inversiones y oportunidades futuras.

Preguntas Frecuentes (FAQ) Sobre IA y Ética

1. ¿Por qué es tan importante la ética de la IA hoy en día?

Porque los sistemas de IA influyen en decisiones críticas en salud, contratación, aplicación de la ley y la vida diaria.

2. ¿Cuál es el mayor riesgo de una IA poco ética?

La combinación de sesgo y falta de transparencia: los errores a gran escala pueden causar un daño social enorme.

3. ¿Cuáles son algunos ejemplos reales de empresas de IA que enfrentaron sanciones?

OpenAI (€15M, 2024) — por recopilar datos sin base legal.

Clearview AI (€30.5M, 2024) — por crear una base de datos biométrica ilegal.

Replika (€5M, 2025) — por no implementar verificación de edad y privacidad adecuadas.

DoNotPay ($193K, 2023–24) — por afirmaciones engañosas sobre ser un “abogado robot”.

Amazon Rekognition (2019) — enfrentó reacción pública por grave sesgo en reconocimiento facial.

4. ¿Existe una regulación global para la IA?

Aún no. La Ley de IA de la UE es el marco más completo hasta ahora.

5. ¿Qué es la Ley de IA de la UE?

Un marco regulatorio que exige transparencia, supervisión humana y prohíbe prácticas peligrosas, con multas de hasta 35M€ o el 7% de los ingresos.

6. ¿Cómo pueden las empresas reducir el sesgo en la IA?

Usando datos diversos, realizando auditorías de sesgo regulares e involucrando supervisión humana.

7. ¿Pueden los niños usar tools de IA de forma segura?

Sí, pero solo si hay salvaguardas estrictas, controles parentales y minimización de datos.

8. ¿Qué papel juega la FTC en la ética de la IA?

Aplica las reglas en EE.UU. contra afirmaciones engañosas de IA y violaciones de privacidad.

9. ¿Por qué fue controvertido Amazon Rekognition?

Porque en 2019 identificó erróneamente a mujeres y personas de piel oscura con altas tasas, generando preocupaciones de discriminación.

10. ¿Cuál es el futuro de la ética de la IA?

Más regulaciones globales, mayor rendición de cuentas corporativa y una creciente demanda de los usuarios por confianza y transparencia.

Lecturas Relacionadas

Apoyo Presidencial de EE. UU. a la IA en 2025

Agentes Autónomos de IA: El Amanecer de la Inteligencia Auto-Ejecutable